书籍整体概述(Introduction & Overview)

写作背景与作者简介:《哈萨比斯:谷歌 AI 之脑》(英文原著名为_The Infinity Machine: Demis Hassabis, DeepMind, and the Quest for Superintelligence_)由著名作家兼记者塞巴斯蒂安·马拉比(Sebastian Mallaby)撰写。马拉比曾两度入围普利策奖决选,著有《More Money Than God》《The Power Law》等畅销书,并在国际经济、金融与科技领域深耕多年。他以记录创新与资本交汇的深度观察闻名,此次的新作基于他对人工智能实验室 DeepMind 及其领导者德米斯·哈萨比斯(Demis Hassabis)长达三年的近距离采访而成。作者在 2022 年 11 月恰逢 ChatGPT 引爆公众关注时获得了 DeepMind 的深度访问权限,从那时起采访了哈萨比斯及其团队百余位 AI 科学家,获取了前所未有的一手资料。这种“空前的访问”使马拉比得以掌握丰富细节,将这位谷歌人工智能掌门人的非凡故事公之于众戴密斯·哈萨比斯(Demis Hassabis),男,1976 年 7 月 27 日出生,毕业于剑桥大学计算机科学专业,GoogleDeepMind 首席执行官兼创始人。。

时代背景与写作目的:本书诞生于人工智能革命的关键节点:深度学习技术突飞猛进,生成式 AI(如 ChatGPT)在短时间内成为全球焦点,人工智能被视为可能“重塑人类历史进程”的力量。作为 DeepMind 公司的联合创始人兼 CEO,哈萨比斯是这一变革时代的核心人物之一。他带领的团队研发出 AlphaGo、AlphaFold 等划时代成果,在人工智能与科学领域引发轰动,并因此于 2024 年获得诺贝尔化学奖。马拉比选择此时撰写哈萨比斯的传记式著作,一方面是为了记录这位“全球最优秀、最执着的科技 visionary(梦想家)”如何引领 AI 创新,另一方面也是意在通过哈萨比斯之眼,对当今席卷全球的 AI 竞赛和伦理争议进行一次“里程碑式的清算(landmark reckoning)”。正如作者在出版方简介中所述,他希望借助哈萨比斯的人生故事,审视这场潜力无比又充满未知的技术革命,并探讨“赢得未来”的真正含义。

内容概览与结构框架:全书采用传记叙事与专题分析相结合的方式,大体按时间线展开,又辅以专题讨论穿插其间,为读者提供对人物与时代的双重透视。开篇章节聚焦哈萨比斯的成长背景和早年经历:作为移民家庭在伦敦贫困社区长大的神童,他 5 岁即崭露国际象棋天赋,少年时期成为出色的游戏程序员。哈萨比斯 17 岁时拒绝百万年薪的游戏行业高薪职位,选择进入剑桥大学深造,体现了他对科学真理的强烈渴求。随后作者描述哈萨比斯如何攻读计算机科学并取得认知神经科学博士学位,汲取多学科养分,以铺就其追求“通用人工智能(AGI)”梦想的道路。

中段章节详述了哈萨比斯在 2010 年创立 DeepMind 及其关键发展历程:团队在人脑认知启发下以游戏为试炼场,突破性地开发出能自学 Atari 游戏和击败围棋世界冠军的 AI(AlphaGo),震惊全球。书中深入记录了 2014 年谷歌收购 DeepMind 的始末,以及 DeepMind 在谷歌麾下取得的科研里程碑,例如解决困扰科学界 50 年的蛋白质折叠难题(AlphaFold)。通过丰富的幕后细节与对相关人物的采访,作者再现了这些重大事件的台前幕后,并分析其意义。

后段章节则转向对现实议题的剖析与反思。马拉比借助对哈萨比斯及其同侪的引述,讨论了 AI 安全与伦理困境(例如是否重蹈原子弹之父奥本海默的覆辙)、硅谷与伦敦两种创新文化的碰撞,以及 OpenAI 等竞争对手的崛起给 DeepMind 带来的挑战。这些讨论升华了传记主线,使本书超越了一般科技人物传记,而成为一部关于人工智能革命的深度思考之作。

领域地位与重要性:作为首部全面描绘哈萨比斯及 DeepMind 兴衰的著作,本书填补了 AI 领域传记写作的空白。一方面,它通过哈萨比斯这一“特别个案”折射出现代科技领袖的群像:在一个“天才扎堆的行业”里,他依然独树一帜。他的故事不仅是个人传记,更代表了 AI 革命浪潮中科研理想与商业力量博弈的缩影。另一方面,作者得以访问大量一手资料和关键人物(包括哈萨比斯的合伙人 Mustafa Suleyman、竞争对手 OpenAI 首席科学家 Ilya Sutskever,以及对 AI 安全深感忧虑的 Geoffrey Hinton 等),这些视角使本书的论述建立在扎实且多元的基础上,具备了权威性和洞见深度。鉴于 AI 技术正深刻影响未来社会治理与全球竞争格局,哈萨比斯和 DeepMind 的故事具有超越个人的意义——正如书中所言,哈萨比斯努力“将新型智能带入世界”的征程本身就是“我们时代的一个定义性故事”。因此,本书在科技与商业写作领域赢得了高度关注。《金融时报》前编辑罗里·斯图尔特评价其“既是我们时代的非凡写照,文字优美冷静,又直面当今最深刻的伦理问题”。可以说,本书不仅是一部引人入胜的科技人物传记,更是洞察人工智能革命的必读之作,为学界业界和广大公众理解这场变革提供了宝贵的坐标系。

核心观点的深入分析(Detailed Analysis of Core Ideas)

本书围绕哈萨比斯及其领导的 DeepMind,在叙事中蕴含了多层次的核心观点和思想框架。以下将对其中最重要的几大观点进行分主题的深入解读,每一部分均结合书中论述、作者引述及具体案例,以揭示这些观点的内涵、依据与意义。

2.1 关于通用人工智能的宏愿与科研驱动力

观点概述:人工通用智能(AGI),即创造出能像人类一样通用学习和思考的机器智能。这一宏愿贯穿其职业生涯,也是 DeepMind 创立的初心。书中详细介绍了哈萨比斯如何将“解决人工智能,然后用它去解决一切其他问题”作为公司使命的核心表达。他相信,AGI 将成为理解宇宙万物运作规律的“终极万能工具”。因此,从在剑桥求学期间起,他就将计算机科学与神经科学相结合,立志站在人类认知与计算技术的交汇处,去攻克这一人类智慧的最终边界。

作者阐释与依据:认知神经科学的钻研为日后 DeepMind 的算法设计提供了灵感——哈萨比斯深信理解人脑有助于设计出更接近人类智能的机器。作者还引用哈萨比斯本人的话解释其初心:“我下决心要把毕生精力投入推动这项技术前沿”,而孩提时代对棋类和智力游戏的痴迷,正是他首次领悟“思考本身的奥秘”并立志探索智能本质的起点。这些细节支撑了这样一个形象:哈萨比斯并非出于名利驱动,而是发自内心的科学求知欲和对智能奥秘的好奇在引领他前行。这也解释了为何他敢于放弃优渥的商业机会(如少年时婉拒高薪工作,坚持求学),因为在他看来,解开智慧之谜的价值远高于短期物质利益。

案例与成就:为了实现 AGI 远大目标,哈萨比斯带领 DeepMind 选择以游戏作为试验平台,循序渐进地提升 AI 智能。这一策略源于他的洞见:游戏环境提供了“完美的 AI 练武场”。书中记录了多个具有标志意义的里程碑案例:

- Atari 游戏自学: DeepMind 早期研发出一种深度强化学习算法,使 AI 特代理解如何通过像素输入玩经典 Atari 电子游戏,且无需人为教导即可自我提高。这个成果在 2013-2014 年震惊学界,证明了通用学习算法在复杂任务上的可行性。作者指出,这项研究正是受哈萨比斯的神经科学知识启发——团队使用类神经网络结构,让 AI 从经验中“学习如何学习”,模拟人脑神经元连接权重调整的过程。该成果奠定了 DeepMind 在强化学习领域的领先地位。

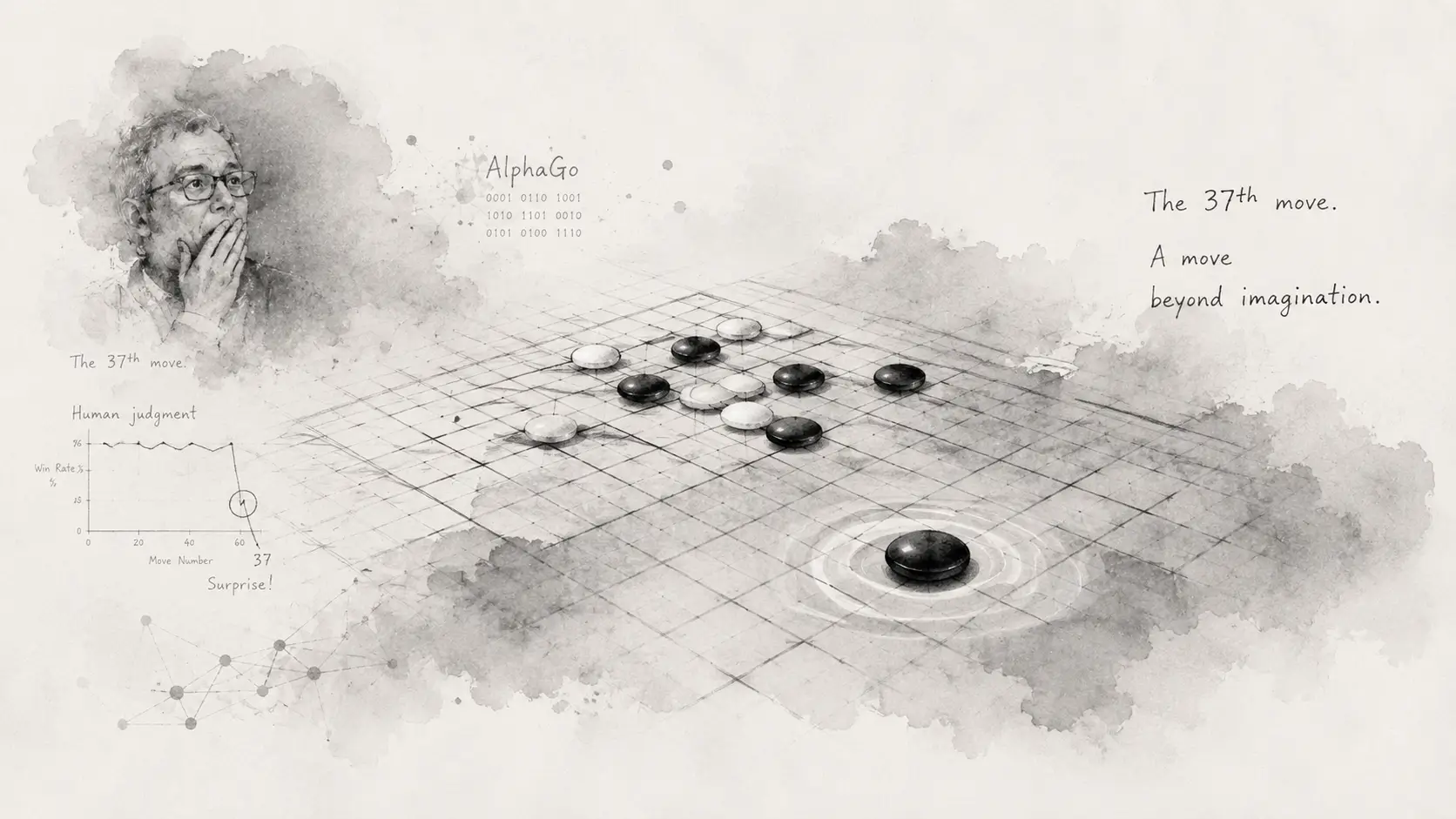

- AlphaGo 大战李世石: 2016 年,DeepMind 开发的围棋 AI AlphaGo 以 4:1 击败世界冠军李世石。这场“人机世纪对决”被书中详尽描绘。围棋被视为人类智慧堡垒,赛前专家预测 AI 尚需 10 年才能超越顶尖人类。AlphaGo 提早十年实现了这一目标,意义重大:其成功标志着机器直觉与创造力的新高度,因为围棋的复杂度极高,AI 展现出的第 37 手“神之一手”令人类大师震惊不已。马拉比引述比赛评论员和研究人员的话描述了这一传奇时刻:职业九段棋手感叹那步棋“非常奇怪”,一度以为是失误,直到赛后才明白它的巧妙。AlphaGo 的创举证明了深度学习和强化学习的强大威力,也让哈萨比斯更加笃信 通用型 AI 可以通过自我博弈等途径达到超人水准。正如《连线》杂志评论所言,这场人机大战的“双重精彩”在于既展现了机器智能的新高度,也激发了人类在与 AI 共舞中迸发的创造力。AlphaGo 的胜利极大提升了公众对 AGI 可行性的信心,马拉比将其称为“AI 革命的转折点”,因为这些核心技术将“重塑从机器人技术到科学研究的一切”。

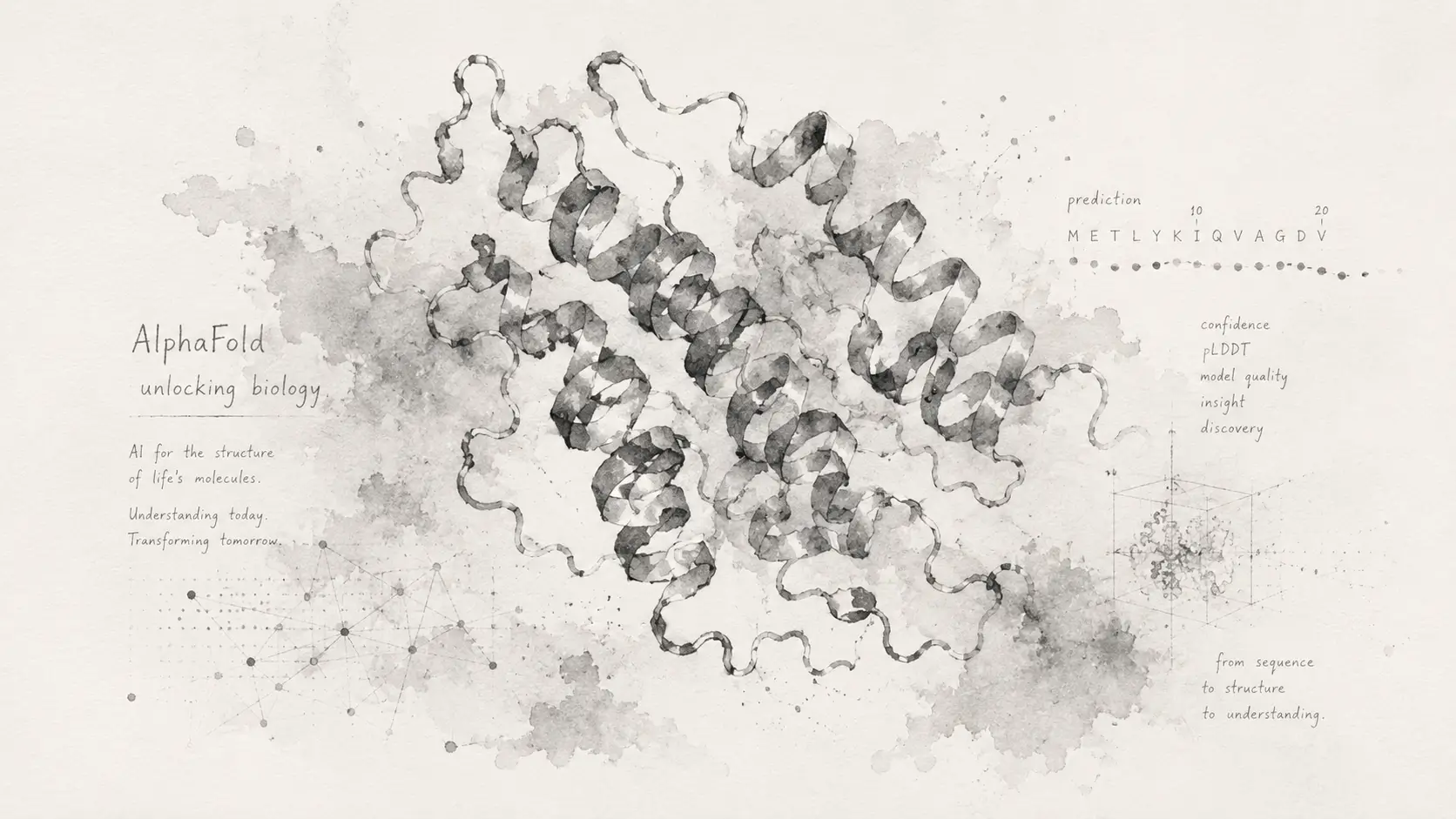

- AlphaFold 破解生命密码: 书中进一步讲述了 DeepMind 在实现游戏 AI 后,将目光投向科学领域的战略转移。哈萨比斯认为,当强化学习和深度网络在棋类等有限环境中成熟后,是时候应用这些技术“解决真正有意义的现实难题”。他选择了生命科学中的“蛋白质折叠”这一长期未解难题作为突破口。AlphaFold 项目经过数年努力,于 2020 年在结构生物学权威竞赛 CASP 中取得突破性胜利,其 AI 模型成功预测出蛋白质的 3D 结构,被评估为“解决了五十年的悬而未决问题”。随后,AlphaFold 2 一举预测了 几乎所有已知蛋白质(超 2 亿种)的结构,并将这些成果免费开放给全球科研人员使用。这一举动极大地加速了生物医学研究,据统计,AlphaFold 数据库推出一年多来已被全球数百万研究者使用,相关论文被引用逾 3 万次,成为生物学研究的标准工具。哈萨比斯将此类比为“相当于在一年内完成了十亿年的科研时间”——可见 AI 的助力如何呈指数级拓展人类发现的速度和范围。AlphaFold 的成功凸显了哈萨比斯及其团队的远见:他们证明 AI 不仅能下棋娱乐,更可以推动科学前沿,实现他所谓“用 AI 造福人类”的愿景。这一成就也直接为哈萨比斯赢得了 2024 年诺贝尔化学奖的殊荣,成为 AI 领域划时代的里程碑。

通过以上案例分析可以看出,对 AGI 的宏大愿景 为书中人物和故事提供了强有力的主线。马拉比以生动笔触展示了哈萨比斯如何坚定地沿着这一方向前进,从游戏 AI 到科学 AI 步步为营。这既让读者直观了解 AGI 概念的实际内涵与进展,也凸显了哈萨比斯作为科研领袖的战略眼光与学术激情。他将人工智能视为继工业革命、电气革命之后最具革命性的力量,坚信“如果正确开发,AI 将成为史上最有益的技术”——例如彻底改变医疗、能源等领域,帮助人类实现“最大程度的繁荣”。这种信念正是驱动 DeepMind 不断挑战极限的精神内核。

同时,作者也不忘揭示这一愿景所面临的巨大挑战与不确定性。在书中后续章节中,马拉比多次提示读者:即便对于哈萨比斯这样的天才人物,AGI 之梦依然充满未知。例如,他在结尾处强调:“这场竞赛的终点无人知晓”——AGI 究竟何时到来、以何种形式出现,以及人类将如何驾驭,都是开放性的问题。这为核心观点增添了理性和审慎的色彩,也为下文讨论 AI 伦理和竞赛风险埋下伏笔。

2.2 人工智能竞赛与全球力量格局

观点概述:本书将 DeepMind 的发展历程置于全球人工智能竞赛的大背景下,提出了“人工智能军备竞赛”这一核心命题。马拉比认为,21 世纪的 AI 竞逐,某种程度上类似冷战时期的核竞赛——赢得 AI 优势的公司或国家,将重塑未来的世界力量版图。书中强调:DeepMind 与其主要竞争对手之间的较量,不仅是企业或科研之争,更关乎“对未来的主导权”。正如封底概要所言,DeepMind 致力于率先构建出人工通用智能,从而“成为人类未来的掌舵者”。这一竞赛具有极高的赌注——马拉比直言其重要性“可能超过七万年前有复杂思想出现以来的任何事件”。

竞赛主体与动力:书中描绘的 AI 竞赛有多重层次:

- 公司层面:DeepMind 与 OpenAI、Anthropic 等顶尖 AI 实验室之间的竞争尤为突出。马拉比通过采访 OpenAI 首席科学家伊利亚·苏茨凯弗(Ilya Sutskever)等人,揭示了不同团队在技术路线和理念上的差异。例如,OpenAI 在 2019 年前后选择大规模语言模型(如 GPT)路线,强调数据和算力的堆叠,而 DeepMind 更专注于强化学习与多模态 AI,并注重兼顾安全。两者的赛跑在 2022-2023 年达到高潮:OpenAI 凭借 ChatGPT 一鸣惊人,让谷歌一度陷入被动;DeepMind 则迅速整合谷歌 Brain 部门资源,研发对标产品 Gemini 以迎头赶上。马拉比引用产业分析指出,ChatGPT 的横空出世让谷歌“措手不及”并引发内部危机感。因此,DeepMind 原本“不急于商业化、偏重科研”的策略被迫调整,和谷歌深度融合加快应用产品开发。这场“创新速度 vs. 安全稳健”的竞赛,突显了不同创新文化的碰撞(这一点下节将详述)。但无论如何,作者强调,这些科技公司间的竞逐最终目的是相同的——抢占 AI 制高点,因为谁先创造出更强大的 AI,谁就可能掌控下一个时代的技术基座和财富源泉。

- 国家层面:国家间的 AI 竞赛 被视为未来全球地缘政治格局变化的关键变量。作者引用国际关系专家的观点称,人工智能的崛起“可能带来全球力量平衡的改写,产生戏剧性的地缘政治后果”。例如,具备领先 AI 能力的国家将在经济、军事和外交上获得重大优势。而那些拒绝拥抱 AI 的经济体将被“抛在后面”。哈萨比斯本人亦多次在采访中强调,欧洲尤其英国应更积极投入 AI,否则将错失引领未来的机会。书中引用了他在英国国民医疗服务体系(NHS)场景下的感慨:英国拥有顶尖 AI 公司和医学资源,却没有善用 AI 来解决医疗体系顽疾,这实为战略机会的浪费。这一论点凸显了国家战略眼光在 AI 竞赛中的重要性。

竞争与合作并存:合作与求衡的动向。例如,他记述了哈萨比斯与 Anthropic 创始人达里奥·阿莫德伊(Dario Amodei)私下交流对 AI 风险的看法:两位分别来自 Google DeepMind 和 Anthropic(一家 OpenAI 分支的新创)的领导者,都 深感责任重大,认为当下 AI 领军者承载了过多压力。他们共同倡议建立国际 AI 治理机构,如仿照国际原子能机构(IAEA)的监管框架,以避免竞赛失控。哈萨比斯更提出一个大胆设想:在全球最后冲刺 AGI 的阶段,各国应合作建立类似“AGI 版 CERN”(欧洲核子研究中心)的国际研究协作平台。这些主张显示,尽管竞争激烈,但顶尖从业者也认识到 AI 具有全球公共属性,需要一定程度的合作与规则来确保竞赛带来的结果利大于弊。这种竞合关系为 AI 竞赛增添了复杂性:一方面谁都不愿落后,另一方面又意识到单边竞争可能引发难以收拾的风险。

典型实例分析:为了印证 AI 竞赛对现实权力格局的冲击,书中和相关资料提供了不少实例:

- GPT-4 冲击波:技术竞赛对商业决策的直接影响:市场领先地位稍有闪失,即引发巨头战略调整。在全球范围,ChatGPT 之于谷歌的冲击也被许多国家看到,激发了欧洲、中国等地对大模型研发的投入提升,催生更多竞品。由此,单一创新事件可能连锁触发全球范围的竞赛升级,这正是 AI 领域不同于以往科技竞争之处——AI 进步的扩散极快,竞争反应也异常迅速。

- 算力军备与芯片战:AI 竞赛不仅体现在软件算法上,也表现在硬件资源上。马拉比在书中侧面提及了 DeepMind 与 OpenAI 在抢夺顶尖 AI 人才和大规模计算资源(如 GPU、TPU 芯片)上的较量。这实际上与国家层面的博弈相交织。例如,美国通过《芯片与科学法案》投入 2800 亿美元加强本土半导体和 AI 研发,限制尖端 AI 芯片向中国输出,以巩固自身在 AI 算力方面的领先。这种“AI 芯片战”凸显了 AI 竞赛已渗透供应链和政策层面:算力被誉为 AI 时代的“核原料”,拥有更多计算力就意味更快训练更强模型的能力。全球最先进 AI 芯片主要由美企英伟达(NVIDIA)生产,2023 年其股价暴涨三倍,市值突破万亿美元,即是因为全球对 AI 算力的需求爆炸式增长。竞争各方无不在囤积高端芯片、建设超大算力中心。DeepMind 作为谷歌旗下部门,占据了谷歌内部海量算力资源,OpenAI 则获得微软 Azure 云计算的鼎力支持。这场无形的“算力军备竞赛”正成为决定 AI 创新速度的重要因素,也折射出大国在科技基础设施上的角力。

- 国际安全与 AI 军用:《时代》杂志报道,十年后的今日谷歌已开始向美以等国军方提供 AI 服务,这意味着当初的承诺不再有效。这一变化从一个侧面反映出国家在 AI 竞赛压力下的策略调整:在军事上不容错失 AI 潜力。各军事强国竞相投入无人机自主控制、情报分析自动化等 AI 项目,激发了对“AI 武器化”的担忧,也引发顶尖 AI 研究者在伦理上的焦虑。DeepMind 自身虽未直接参与武器开发,但其人才和技术输出无法完全与军方隔绝。例如,DeepMind 重要人物穆斯塔法·苏莱曼离开公司后联合创办的 Inflection AI,和哈萨比斯老友埃隆·马斯克新组建的 xAI,都获得了来自国家基金或军工背景资本的关注。这些现象都表明,AI 竞赛正在全方位影响国际竞争与合作:技术、经济、军事、法规等领域彼此交织,一个国家若能在 AI 上抢跑,就可能在这些方面取得系统性优势。

批判性分析:马拉比在书中虽然肯定了 AI 竞赛带来的动力,但也隐含着警示:当竞争被形容为“武器竞赛”乃至“生存竞赛”时,各方可能倾向于忽视安全边界而一味求快,进而埋下风险隐患。例如,Anthropic 创始人阿莫德伊就坦言:“几乎每一个决策都如履钢丝——如果我们进展不够快,威权国家可能抢先;但如果我们走得太快,哈萨比斯担心的那些风险又可能出现”。他直言无论哪种失误,自己都将深感自责。这段引述道出了 AI 竞赛的两难:慢一步可能输掉未来霸权,快一步可能引发失控危机。哈萨比斯本人也承认这种两难使他夜不能寐。因此,在惊叹 AI 竞赛如火如荼的同时,作者呼吁读者保持清醒——如何在竞争中保持理性克制、加强国际协作,防止最坏情况发生,这是比竞争本身更大的考验。

综上,《哈萨比斯:谷歌 AI 之脑》通过描述人工智能领域的激烈竞逐,揭示了技术实力正在成为新世纪全球权力的重要筹码这一核心观点。它让我们看清,AI 不仅是商业创新,更是各国博弈与人类未来走向的关键变量。同时,作者也强调竞赛需要规则和良知的约束,否则可能“颠覆全球权力平衡并改变社会性质”。这种张力贯穿全书,也为下文关于 AI 伦理的讨论提供了现实依据。

2.3 技术伦理与“奥本海默困境”

观点概述:人工智能的伦理风险及研发者的道德责任。马拉比借哈萨比斯之口,将这一两难境地下的抉择称为“奥本海默困境”——暗指原子弹之父罗伯特·奥本海默在研发核武后内心备受谴责的历史隐喻。对于创造出可能失控且具有生存级威胁的新技术,科学家该如何自处?这是哈萨比斯等 AI 领导者日益面对的问题。本书深入探讨了哈萨比斯在追求 AGI 过程中的警觉与不安:他既渴望实现技术飞跃,又时时担忧 AI 一旦发展不当会带来灾难性后果,例如AI 失控或者被不良行为者滥用。

哈萨比斯的立场:马拉比通过多段哈萨比斯的引言,展现了这位 AI 领军人物对伦理问题的深刻思考和复杂情感。哈萨比斯直言,自己“经常担心会不会走上奥本海默的道路”,以至于“夜不能寐”。他说:“我时时刻刻都在忧虑这些场景,这就是我为何睡得很少”。这番话凸显了他内心对 AI 潜在负面结局的恐惧和责任感。他进一步将 AI 研发者当前所承受的压力描述为“巨大且或许过度的责任”,因为这项技术的影响太深远,而决策又集中在少数人手中。

在具体风险方面,哈萨比斯重点提到两大类威胁:

- 一是“坏行为体”利用 AI 为恶:他担心开放强大的通用 AI 技术后,恐怖组织、独裁政权或网络犯罪分子等不良方会将其改造成武器,带来严重危害。例如深度伪造、自动化网络攻击,甚至 AI 驱动的生化武器设计等。这属于外部风险,即技术落入不当之手。

- 二是 AGI 本身的失控:随着 AI 走向高度自主和智能,它可能不受人类价值观约束,出现“目标错位”或自我演化,最终对人类不利。这类似科幻作品中的 AI 反叛情节,也是许多未来学家担忧的“奇点”隐患。哈萨比斯提到,这要求确保 AGI 有“正确的价值和目标”,以及“能够被我们掌控”。

他强调,这两类风险都“至关重要,必须全力解决”,而且“全世界都需要关注”。因此,哈萨比斯一方面倡导抓住 AI 带来的“难以置信的机遇”(如用于科学和医疗),另一方面不断提醒业界和社会重视伴生的巨大风险,主张一种“平衡视角”:既充分认识 AI 造福人类的潜力,也清醒防范其威胁。

DeepMind 的自我约束:书中列举了哈萨比斯和 DeepMind 为践行伦理责任所采取的一些措施。例如,DeepMind 自加入谷歌后即要求在收购协议中加入禁止将其技术用于军事实体的条款。哈萨比斯认为,将 AI 用于武器化不符合“造福人类”的初衷。然而,马拉比也记录了现实对理想的冲击:十年后,谷歌公司开始向美军和盟国提供 AI 支持,等于不再遵守当初的限制。当记者在 2025 年采访哈萨比斯问及此事时,他不得不承认,为了利用谷歌庞大资源追求毕生 AGI 目标,他在某种程度上“做出了妥协”。这段访谈呈现了技术理想主义者在商业现实下的无奈:当掌控资源的公司改变政策,个人初心也难以坚守。哈萨比斯面对质疑,依然强调他希望 AI“正确且负责任地被开发”,但也默认了自己当初的反战承诺未能长久维持。这个例子反映了伦理理想与利益现实的矛盾,是作者批判性分析的一部分:它提醒读者,哪怕是有道德责任感的科学家,也可能在强大体制面前妥协。因此,制度保障与公众监督对于 AI 伦理落实至关重要,不能仅寄望于个人自律。

DeepMind 在公司内部也早早成立了 AI 伦理与安全团队,研究如何减少 AI 偏见、增加模型可解释性等。本书虽未大篇幅描述,但提到哈萨比斯对安全团队的支持,以及他对外倡导行业规范。例如,他呼吁建立 AI 研发的独立监管机构,甚至提出国际层面的合作治理模型。这些举措表明,哈萨比斯并非一味追求速度,对“安全至上”有一定共识。马拉比借此强调:“发明者以为自己能控制技术,但往往最终却被技术所控”。这句点睛之笔既道出奥本海默式的悖论,也隐含批评:如果连心怀善意的顶尖科学家都难以完全掌控自己创造的东西,那么我们必须慎之又慎。

不同视角的争论:审慎派:他们认为 AGI 可能带来 存在性风险(existential risk),主张预先采取防范措施,包括暂停训练过于强大的模型、制定国际条约等。Hinton 在 2023 年甚至辞去谷歌工作,公开警告 AI 可能“威胁人类存亡”,这在书中有所提及。另一端则有乐观派(或称激进派),如 Meta 的首席 AI 科学家 Yann LeCun 等人,他们认为 AGI 失控是杞人忧天,过度渲染恐慌会阻碍技术进步。这种观点在书中由特斯拉创始人埃隆·马斯克的评价体现:马斯克曾称哈萨比斯是“邪恶天才”——隐含他对 DeepMind 在谷歌体系内不透明研发 AGI 的猜忌和不信任(马斯克一度主张开放 AI 研究,因担忧单个公司独大)。马拉比并未偏袒某方,而是客观呈现这些争议,让读者自行评判。通过引述马斯克、苏莱曼等人的批评意见,书中展示了一种张力:即一方面哈萨比斯被许多人视为 AI 英雄,但另一方面也有人对他及 DeepMind 心存戒备,担心他们的技术可能失控或被滥用。这种矛盾正是 AI 伦理讨论的现实写照。

关键案例分析:为了说明伦理挑战,书中外的信息还提供了实例:

- 患者数据争议:手段上缺乏透明与尊重,导致公众信任受损。马拉比指出,批评者指责 DeepMind“秘密转移超范围的患者数据,几乎可为所欲为”。最终 DeepMind Health 部门在 2019 年被谷歌直接接管,此事成为 AI 落地实践中“好心办坏事”的经典案例。这警示 AI 研发者:即便目标是公益,过程也必须合规并尊重伦理,否则将事与愿违。

- 社交算法危害:算法偏见与信息茧房等现象。例如,Facebook、YouTube 的推荐算法(也是 AI 的一种)曾被曝光会放大极端内容以博眼球,导致社会撕裂。这提示我们,AI 系统即使不具有人类智能那样的恶意,仍可能因为优化不当目标(如只顾提升点击率)而造成负面后果。在马拉比与哈萨比斯的对话中,也涉及如何给 AI 设定正确的价值准则的问题。哈萨比斯反思道:“如何让好的行为者利用技术造福,同时限制坏的行为者?以及如何确保 AI 系统本身拥有正确的价值观与目标?”。这些追问直指算法治理的核心。这方面现实教训包括微软的聊天机器人 Tay 在网上被用户“教坏”发表种族歧视言论,亚马逊的 AI 招聘系统被发现歧视女性候选人等等。尽管书中未具体列举,但这些广为人知的例子为哈萨比斯的担忧提供了注脚:AI 会反映训练数据和人类社会的偏见,如果开发者不加以干预,AI 将毫无道德判断地放大这些偏见或不良倾向。

- AI 安全倡议:AI 伦理从业界共识走向公共政策 的重要一步。马拉比点出,哈萨比斯很早就将 AI 安全提上议程,例如在 2016 年围棋赛后就成立了 DeepMind Ethics & Society 部门,研究 AI 对社会的长期影响。这些努力虽未能完全消弭风险,但至少表明 顶尖 AI 开发者正努力避免成为下一个奥本海默:他们希望在技术爆炸前引入安全机制,而非事后忏悔。

综合评价:通过上述分析可见,“奥本海默困境”是贯穿本书的一条暗线,折射出人工智能革命中研发者的道德两难。马拉比对这一主题的处理有两大特点:其一,他以哈萨比斯个人的真实经历和言论为切入,使宏大的伦理议题具象化、人格化——读者能感同身受地体会到一位 AI 先驱内心的激情与焦虑交织。其二,作者将不同立场的观点置于对话中,呈现了伦理争议的多面性,而非简单说教。例如通过马斯克等人的质疑声,提醒我们警惕所谓“AI 救世主”的盲点;通过现实案例,展示即使好人好 AI 也会出错的可能。最终,本书在呼唤负责任创新的同时,也呼吁建立更健全的外部约束和全球合作,使 AI 的发展在安全轨道上运行。哈萨比斯自己的表态总结了这一点:“AI 有潜力帮助解决人类最大挑战,但将影响所有人,所以我们必须让社会各界广泛参与”。这一理念与其说是技术论断,不如说是深刻的伦理反思:在创造超越自身的智能时,人类需要超越自身的分歧与弱点,携手确保智慧之火造福众生而非毁灭一切。

2.4 创新理念的分野:科学探索 vs 硅谷模式

观点概述:书中鲜明地对比了哈萨比斯领导的 DeepMind 与典型硅谷科技公司的不同理念与文化,提出“科研驱动的创新”与“商业驱动的创新”“科学家精神”:以追求真理和长期愿景为导向,不急于短期盈利,而注重基础研究和突破性发现。他曾将 DeepMind 的使命描述为“两步走”:首先实现人工智能本身,其次用它去解决人类面临的一切难题。可见第一步本身就是纯科学目标,无关商业化。然而,他的这一路线在现实中要与硅谷典型的快速迭代、资本驱动模式相抗衡。马拉比用了颇具戏剧性的方式描述这种对比:哈萨比斯虽然身处谷歌这个硅谷巨头内部,却“并非一个硅谷故事”。他“与硅谷有来往,也接受其资金,但仍然身在外部并对其领导人猛烈批评”。这种描写强调,DeepMind 的文化与谷歌其他部门乃至整个硅谷存在距离:前者更接近学术机构的风格,后者则讲究商业化和增长。

科研至上 vs 商业至上:马拉比采访中,哈萨比斯坦陈了他对硅谷某些风气的不满。例如,他曾批评同行中的一种“鲁莽态度”,好比一些实验者“没意识到自己手里拿的是危险物质”。这被认为是影射 OpenAI 等急于“快速行动、破除常规”而忽略风险的做法。哈萨比斯主张相对克制,他在 ChatGPT 未问世前就告诫不要“一味快跑弄坏东西”。这代表了一种更谨慎的工程伦理。然而 OpenAI 的成功也反证了硅谷模式的强大:在短短几年里,OpenAI 通过频繁发布模型、积累用户反馈和商业资源,取得了巨大影响力,而 DeepMind 虽有 AlphaGo 和 AlphaFold 名震天下,但在消费市场上声量较小。马拉比不回避这一现实差距,并通过人物引语道出其中原因:“有的科学家追逐技术是出于对发现之甜美无法抗拒;也有人追逐 AI 是为名利或权力”。DeepMind 属于前者,OpenAI 等部分竞争者则带有后者色彩。这种动机不同导致了策略差异:一个愿意深耕基础、不急变现,另一个敢于冒险、商业优先。

DeepMind 文化特色:书中将 DeepMind 描绘成一个有别于典型硅谷创业公司的存在,更像贝尔实验室或 Deep Blue 时代 IBM 研究院的翻版。哈萨比斯招募顶尖博士和程序员,给予他们相对宽松的研究环境,不设明确盈利 KPI,多项研究纯粹为了学术突破而做。这一点在 AlphaFold 项目上体现明显:投入巨大人力物力攻克的蛋白质问题并不会直接给谷歌带来短期利润,却被 DeepMind 视为践行“造福人类”使命的核心案例。这种情怀得到许多科学界人士赞赏,也使 DeepMind 赢得了与众不同的学术声誉。然而它也带来内部紧张:摩擦与平衡:谷歌高层一度容忍甚至支持 DeepMind 的学术取向,因为这些壮举(如 AlphaGo 夺冠、AlphaFold 得奖)为谷歌赢得科技声誉加持。谷歌联合创始人拉里·佩奇最初投资 DeepMind 也是出于对 AGI 愿景的共鸣。但当 OpenAI 掀起行业变革、微软携手 OpenAI 挑战谷歌核心业务后,谷歌不得不调整策略,将 DeepMind 与自家部门整合以加快产品化。科研理想终究让位于商业竞争,这对 DeepMind 文化是重大冲击。Mustafa Suleyman 等联合创始人与哈萨比斯在方向上产生矛盾,前者在 2019 年被传因“过激管理风格”休假,后转至谷歌母公司任职,再不久离职创业。外界分析其离开部分原因是对 DeepMind 迟迟无法盈利、在谷歌内部地位尴尬的不满。苏莱曼后来公开表示:“AI 本质上是一种会取代大量劳动的工具”,他更倾向于积极部署产品而非坐等长远理想。这一内部冲突体现了 DeepMind 科研文化与科技公司业绩压力的矛盾。

硅谷批评与自省:马拉比也让哈萨比斯反思硅谷式创新的弊端。例如社交媒体的例子说明,追逐用户注意力和增长的商业模式,会产生社会负外部性(假新闻、极端化等)。哈萨比斯在书中多次“怒斥硅谷领袖”,认为他们在某些方面极其短视。可以推断,他所指包括对 AI 安全漫不经心的创业者,以及过度逐利、不顾道德的公司。DeepMind 的存在某种程度上是对此的反动:它接受硅谷的资金,但试图秉持学术道德。然而,正如前述,当竞争加剧时,即便哈萨比斯也不得不向现实让步。马拉比通过这种对比,提出耐人寻味的问题:在一个由风险投资和巨头把持资源的时代,理想主义研发模式能走多远?科学探索模式与商业速赢模式拉锯战的写照。

典型案例:为了具体说明两种模式差异,以下实例可进一步阐明:

- 研发投入与视野:属于战略性长线价值——AlphaFold 提升了谷歌在科研界和公众心目中的品牌形象,并可能在未来衍生出药物发现等产业机会。相比之下,典型硅谷创业公司很难如此“任性”地长年无收入运转,除非有足够的风险投资撑腰且投资人认可远期回报。这体现了 DeepMind 特殊的地位:得益于谷歌的财力和耐心,它才成为硅谷急功近利风气中的异类。然而 2020 年代的市场环境愈发短视,谷歌本身在资本市场压力下也要求提高效率。因此马拉比暗示,这种高投入慢产出的模式可持续性堪忧,最终 DeepMind 仍要承担内部商业化重任(如开发谷歌旗舰 AI 产品 Gemini 等)。

- 产品导向 vs 科研导向:以聊天机器人为例,OpenAI 的 ChatGPT 之所以大获成功,不仅因模型强大,更因其通过公开测试收集了海量用户反馈,快速改进。OpenAI 采取的是“边产品化边完善技术”“技术成熟后再产品化”。例如 DeepMind 很早就有对话 AI 研究,却没有立即推出面对公众的产品。一个据称内部代号为“斯巴达”的对话模型项目曾在谷歌推行,但进展缓慢,反被 OpenAI 后来居上。这说明硅谷模式强调尽早将技术推向市场,通过市场倒逼技术完善;而哈萨比斯更习惯在实验室打磨到满意再亮相。两种路径各有利弊:前者冒风险但先机可得,后者稳健但可能坐失良机。ChatGPT 事件后,哈萨比斯也不得不接受产品驱动的重要性,他在接受采访时表示对打造新一代 AI 助手“非常兴奋”,透露 Google DeepMind 正研发代号“Project Astra”的通用个人助理,希望它能理解现实世界、帮助人们日常事务。这种表态显示,DeepMind 正在向硅谷模式靠拢,把科研成果更快转化为产品形态。可以说,这既是被竞争倒逼,也是哈萨比斯自身理念的扩展:他开始认可产品落地也是实现愿景的必要环节,而非科研的对立面。

- 公司治理和人才观:科研文化与商业文化在管理上的冲突。最终,DeepMind 通过与谷歌更深融合、接受更严商业目标的方式,部分放弃了原先的理想主义管理。例如 2023 年后 Google DeepMind 开始明确追求在消费产品(如搜索、地图)中应用其 AI 技术,而不再仅仅发表论文。人才上,DeepMind 过去偏爱招学术新秀,不计成本给出伦敦顶级薪水,导致内部人力成本极高。这在谷歌营收高增长期无妨,但在缩减开支的大环境下受到质疑。马拉比虽然没有在书中详细列出财务数字,但从他对 DeepMind 和 OpenAI 不同资源使用的描述,可推知 DeepMind 的投入产出比远高于 OpenAI——后者靠较少人力经费撬动了更大影响。这进一步加剧了外界对 DeepMind 模式的议论。作者站在第三方角度,没有断言孰优孰劣,但通过这些比较,他激发读者思考:创新的价值应如何衡量?是论文、奖项和长远贡献,还是立竿见影的用户规模和利润?理想主义和实用主义如何平衡?这些问题超越了个别人物,发人深省。

总结与批判:在这一章节的解读中,我们看到马拉比试图传达这样一个核心洞见:科技进步的价值观:我们是为什么而创新?为了更深的认知突破,抑或仅仅为了股价和垄断地位?通过这层对比,读者能更全面地理解人工智能领域的内在动力学,并对未来 AI 发展路径的选择有所启发。这种跨文化反思,使得本书超越了一般传记,对科技产业有了社会学与哲学意义上的关照。

(小结:以上四节详细分析了书中核心的几个思想主题,包括对 AGI 愿景的执著、AI 竞赛的权力意义、伦理两难及创新模式之争。从人物故事出发,延伸出对技术与人类关系的深入探讨。这为后文跨学科延展和实践结合的分析打下了思想基础。)

跨学科视角的深度融合与理论延展

本书的核心思想不仅局限于人工智能技术领域本身,还与多个学科领域产生了共鸣和对话。哈萨比斯和 DeepMind 的故事涉及经济学、社会学、心理学、哲学、管理学以及国际关系等诸多方面。作者马拉比在阐述时也主动将 AI 放置在更广阔的社会科学和人文脉络中考察。以下我们将从几个主要学科视角出发,深入分析书中思想的跨领域融合,并探讨如何将这些理论进一步延展,以对接当代学术前沿和现实问题。

跨学科视角的深度融合与理论延展

经济学与管理学视角:技术创新与资本驱动的平衡 – 从经济学角度看,DeepMind 的发展凸显了创新与资本之间的张力和平衡。传统经济理论强调,重大技术创新往往需要长期投入而非短期逐利,这在哈萨比斯的实践中得到印证:DeepMind 多年来依靠谷歌的“耐心资本”支持,才能在无直接收益的情况下持续推动科研。这类似经济史上贝尔实验室等机构由垄断企业资助基础研究的模式。然而,经济学家也指出市场竞争会迫使企业更快将技术商品化、实现盈利目标。正如马拉比对比的,OpenAI 在微软巨资注入后迅速推出收费产品 ChatGPT,就是资本驱动创新加速的体现。这可用熊彼特的“创造性破坏”理论来解读:创业公司在风险投资支持下,快速创新并扰乱巨头地位,倒逼既有公司回应。DeepMind 和谷歌的关系也符合公司金融和公司治理理论:当创新部门回报不明时,母公司会加强控制、要求协同商业化,以提高资源配置效率。从管理学上讲,这涉及研发组织的设计:是允许研究人员自由探索(探索式创新),还是强调与产品部门紧密合作(利用式创新)。马拉比记录了谷歌从前者逐渐转向后者的过程,这可视作安索夫矩阵中企业从专注探索新技术(多元化)转向更贴近核心业务应用(相关多元化)的战略调整。通过这个经济-管理视角分析,我们明白了 DeepMind 案例对创新政策的启示:国家和大企业需要在容忍长期投入与追求短期绩效间取得平衡,鼓励“耐心资本”投入真正颠覆性创新,同时也利用市场竞争提升研发效率。近年来,各国纷纷加大对 AI 的战略投资(如美国 CHIPS 法案投入巨额资金于 AI 和半导体),正体现了经济学界“政府在通用技术发展中应扮演积极角色”的主张。哈萨比斯的故事证明了这一点:没有谷歌的资本护航,DeepMind 不可能取得如今成就;但同样没有 OpenAI 等竞争压力,DeepMind 也许不会这么快走出实验室。经济规律与管理实践在此融合,说明健康的创新生态需要既有长期投入又有竞争压力。马拉比通过叙事很好地诠释了这一点,在理论上与经济管理学思潮形成共鸣。

社会学与心理学视角:技术革新对社会关系和人类心态的冲击 – 社会学的视角关注技术与社会变迁的互动。本书描述的 AI 革命无疑是一场深刻的社会变革,值得从社会学理论加以阐释。首先,AI 技术引发了劳动力市场和社会结构的变化预期。哈萨比斯联合创始人苏莱曼直言,AI 是“根本上的劳动替代型工具”。社会学中,技术失业和社会不平等问题由来已久。AI 尤其是 AGI 可能导致某些职业大规模消失,同时高度专业人才和资本所有者获益更多,这涉及技能偏向型技术变迁理论。马拉比虽然没有直接援引社会学名词,但通过各方言论暗示了这种担忧:AI 竞赛胜者通吃,社会财富和权力进一步集中于少数科技巨头,引发“数字鸿沟”拉大。其次,从社会心理学角度,书中刻画了 AI 在公众认知中引发的情绪和观念转变。AlphaGo 战胜人类、ChatGPT 流行全球,这些事件在集体心理上带来了冲击效应:有人兴奋于未来,有人恐惧于未知。社会学家罗杰斯的创新扩散理论可解释,社会群体对 AI 的态度分化:有早期接受者(科技乐观派)积极拥抱 AI,也有落后群体(技术怀疑者)抗拒甚至恐慌 AI。马拉比通过报道各界反应体现了这种分化。例如,学界和媒体对 AlphaFold 大加赞赏,而部分公众对 AI 抢工作表示焦虑。心理学上,这涉及“未知恐惧”和“控制幻觉”:人们倾向于对不可控的新事物感到害怕,对 AI 特别如此。哈萨比斯在 Cambridge 演讲中强调,需要让社会各界参与对 AI 的讨论,这体现了社会建构主义的视角:技术的意义和运用需要通过社会协商形成共识。在现实中,AI 伦理原则的制定、AI 法规的出台都离不开公众参与和价值博弈。从社会学宏观理论看,AGI 可能被视为一种“颠覆性结构变迁”(disruptive structural change),它或将重新定义工作、教育、人与机器关系等社会基本要素。哈萨比斯本人强调,AGI 若正面发展将带来“空前人类福祉”(如治愈疾病、解决气候等),这可被视为对传统结构功能主义的呼应:技术进步有望提高社会体系对功能需求的满足。然而,他也警告 AI 失控的风险,那将对应冲突理论或灾变理论的视角:技术可能带来社会秩序的解体与重组(在极端情况下,AGI 若敌对人类会彻底改变人类社会的基本结构)。因此,《哈萨比斯:谷歌 AI 之脑》的讨论不仅是个人传记,更隐含着对 技术-社会相互塑造的学理思考。将这些内容与涂尔干、韦伯等社会学家的理论对照,可以更清晰地认识 AI 革命对社会规范、伦理和机构的挑战。书中对“奥本海默困境”的探讨特别契合韦伯的理性化和责任伦理观:科学家的理性追求必须辅以价值理性,否则技术理性可能导致“工具理性僭越价值理性”的风险(如核武和 AGI 的潜在毁灭性)。哈萨比斯承担责任、呼吁治理,就是试图将价值理性重新纳入技术进步的轨道。

哲学与伦理学视角:人工智能引发的终极问题 – 从哲学层面,本书引出了许多引人深思的终极性问题,涉及心灵哲学、认识论和伦理哲学等领域。首先,AGI 的可能实现挑战了长期以来哲学对心灵与智能本质的探讨。图灵在 1950 年提出“机器能思考吗”这个问题,经过 70 余年,哈萨比斯的工作让我们前所未有地接近“是”的答案。这引发了经典的心灵哲学二难:强 AI 能否拥有意识?如果能,人类如何定义自我与工具的界限?如果不能,那么智能与意识的区别何在?马拉比在书中提及,AlphaGo 的“神来之笔”让很多人赋予其“直觉”“创造力”等类似心灵的描述。哈萨比斯本人对意识问题也有所涉猎,他在剑桥讲座中谈到对大脑原理和意识涌现的兴趣。哲学家西尔勒曾提出“中文房间”思想实验质疑 AI 的理解力,而哈萨比斯希望通过神经科学+AI 的路径真正解开意识奥秘。可以说,DeepMind 的研究让心灵哲学理论从思辨走向实验:AlphaFold 证明了机器可以洞察生命结构的奥秘,AlphaGo 展示了机器可以自主形成策略。这些案例支持功能主义心灵观的一种极端:智能行为不需要生物大脑也能实现,从而动摇了很多哲学预设。其次,伦理哲学中,本书一再讨论技术的善恶问题。亚里士多德区分科技(Techne)使用需以伦理(Ethos)为指导,否则将偏离善。在 AGI 背景下,这一古老命题变得异常紧迫。马拉比赋予哈萨比斯某种“哲学家-科学家”的角色,让他扪心自问科技应遵循何种善的目标。哈萨比斯引用“奥本海默时刻”来提醒同行,知识的诅咒随时可能降临:就像原子能带来核弹阴影,AI 也可能带来不可控的结果。这种反思与近年技术哲学对“新原子弹问题”的研究相一致。哲学家 Hans Jonas 在《技术的责任》一书中提出,人类对自己创造的强大技术负有前所未有的责任,需建立一种“恐惧启示的伦理”(即对技术潜在灾难保持敬畏)。哈萨比斯正是这种伦理的践行者:他坦承自己担忧失眠,以实际行动呼吁规范 AI。从道义论和结果论角度来看,AI 伦理兼具两者:我们既要遵循原则(不伤害、尊重人类价值),也要考虑后果(AI 长远影响)。书中哈萨比斯对于 AGI 理想和风险的权衡,其实体现了一种 谨慎的功利主义:AGI 若成功,可以带来极大善(解决疾病气候等),但必须防范极大恶的尾部风险。因此他主张在安全性上绝不冒进。这与密尔等人的功利主义思想相呼应:最大幸福原则也要求避免极大痛苦的可能。最后,哲学还有一支脉络是存在主义,AI 逼近类人智能让许多人产生存在危机感:如果机器也有智慧,人类的独特意义何在?书中没有展开这一点,但 AlphaGo 赛后李世石一度退役、科普作家纷纷撰文探讨“机器超越我们会否令人生失去意义”,这些都是存在主义的提问。马拉比通过叙述 AlphaGo 比赛中特写李世石的复杂神情、以及赛后围棋界的震撼,其实已经触及这个问题——所幸李世石和人类在第四局以妙手证明了人类依然有独特创造力。这被一些评论解读为“人机共生”的希望:AI 激发人类新的智慧火花,而非取代我们。从 existential risk 的担忧到 existential hope 的憧憬,哲学思考贯穿 AI 发展。马拉比并未提供终极答案,但他的记录将这些哲学议题鲜活地呈现在读者面前,让我们意识到 AGI 不是纯工程问题,更是哲学意义上的“人类之问”。这体现了跨学科融合:科技传记引发哲学省思,哲学观照又为理解科技指明方向——正如罗里·斯图尔特评价该书“目光清明地参与我们这个时代最深刻的伦理讨论”,表明马拉比成功地将哲学伦理深度融入了叙事之中。

上述跨学科视角的分析表明,《哈萨比斯:谷歌 AI 之脑》一书的内容远超出人工智能领域本身,在经济学、社会学、心理学、哲学等多个学科中都引起了理论共鸣和延展讨论。这种多领域的融会贯通体现了人工智能作为“通用目的技术”的特性:它的影响渗透经济、社会、政治和思想文化方方面面。作者马拉比敏锐地捕捉到这一点,在撰写过程中主动汲取跨学科见解,使本书不仅是一个人的传记,更是一幅横跨诸学科的时代思想图景。这也启发我们,理解 AI 革命需要综合多学科知识,不仅要问“如何实现”,更要问“意味着什么”“应该怎么做”。在下一节中,我们将进一步结合当代最新理论和研究,探讨如何将本书的观点向更高层次推进。

高阶理论的深度整合与观点延伸

在掌握了书中的核心思想并考察其跨学科意义之后,有必要对这些思想加以系统性提炼,并结合最新学术进展进行延伸和再思考。以下我们从理论框架、前沿研究和概念创新三个方面,对书中主要观点进行更高层次的整合与拓展。

核心理论框架的归纳:“负责任的技术革命论”。其要点包括:

- 技术潜能论:人工智能被视为继工业革命、电气革命之后改变世界的下一个“范式转移”技术,具有通用目的技术(General Purpose Technology)“重塑政治、经济和社会”。这与当代技术预见理论(foresight)所描绘的情景一致,即 AI 属于改变游戏规则的“颠覆性创新”。

- 竞合博弈论:AI 发展既表现为竞争(公司间、国家间的竞赛),又需要合作(共同的治理与安全努力)。这形成一种“竞合博弈”博弈论中的协调博弈模型或公共物品理论来延伸理解 AI 治理的难题和出路。例如,开发超级 AI 类似提供全球公共物品(或公共坏物),各国应合作设立规则,就像控制核扩散一样。这将书中叙事上升到国际制度理论层面。

- 伦理制约论:AI 革命必须辅以伦理和制度的强力制衡,否则将出现“技术-伦理时滞”,即科技力量超前而道德约束滞后导致的风险(如 AI 失控)。这与哲学家 Hans Jonas 提出的“责任原则”风险社会理论(乌尔里希·贝克),该理论认为现代社会创造了无法完全预测和控制的系统性风险(如核风险、生态风险),需要新的反思性现代化。AI 正是一种新型系统性风险,书中的论述与风险社会论高度契合:哈萨比斯与同侪的忧虑实际上是在推动一种反思性过程,希望社会在风险降临前预作应对。这拓展了传统伦理学范围,将对未来世代和全人类福祉的责任纳入决策考虑。

通过以上三点,可以看到书中思想构成了一个整体框架:技术潜能需要伦理驾驭,在竞争中寻求合作。这一框架既总结了哈萨比斯的理念,也映射出当代 AI 发展的客观趋势。为了进一步拓展,我们可以引入近年来的新理论:

- 人工智能治理理论:近年兴起的 AI 治理(AI Governance)学术领域提供了许多框架,可与本书观点互补。比如剑桥大学的 AI 治理研究提出“国家法律与行业自律补位的情形。例如,2023 年欧美开始制定《AI 法案》(如欧盟 AI Act),将关键 AI 系统列为高风险,需要强制审查和合规。这些举措正是呼应哈萨比斯“全世界需要关注”的呼吁。理论上,可以运用监管科学和多方共治理论分析 AI 治理最佳路径,包括软法(行业准则)与硬法(政府监管)的结合。

- AGI 预测与安全理论:AGI 何时出现、如何确保安全,是当前前沿讨论的热点。一些新兴理论值得纳入延展。例如“火箭机制”安全与性能同步推进。此外,OpenAI 提出过“GPT-4 风险分析”,引入 AI Constitution 概念,即为 AI 设定一套价值准则让其遵循,这可以视为机器伦理的新理论探索。本书虽然成书时未详述此类技术,但马拉比提到确保 AI 有“正确的价值和目标”,其实与 AI Constitution 理念暗合。将这些前沿理论纳入,可以丰富我们对如何落实责任原则的想象。例如未来 AGI 或许需要嵌入类似阿西莫夫机器人三定律的原则,只是远比科幻复杂,需要融合机器学习、逻辑约束和人类反馈等方法。

- 超智能与人类未来理论:针对 Nick Bostrom 在《超级智能》中提出的各类 AGI 结局(全球垄断、延缓研发、AI 治理 Singleton 等),书中哈萨比斯所采取的路径似乎是寄望于一个受控的、利他型超级智能在全球框架下出现。这对应 Bostrom 所说“友好 AI”的概念。新理论上,可以结合“多代理安全”外部可信承诺(如各国签署条约限制训练超规格 AI),才能避免“安全耗散”局面。这将理论推向一种 AI 国际和平 的构想,与核不扩散有相似逻辑。近期一些论文建议仿照冷战时期的 Baruch 方案建立 AI 的全球限武协议,就是此方向的体现。哈萨比斯等人的国际合作呼吁可以看作实际倡议雏形,理论层面值得进一步探究其可行性和执行细节。

综上,通过高阶理论的整合与延展,我们可以将本书核心观点提升到更系统、更前瞻的层次。一方面,归纳出“负责任技术革命论”这样涵盖技术潜能、竞合博弈、伦理制约的框架,帮助我们理解 AI 变革的本质逻辑;另一方面,结合 AI 治理、安全和未来学等新理论,将书中观点延伸到当下学术与政策讨论的前沿,使其具有现实指导意义。例如,从书中得到启发,我们可以预见未来研究重点将包括:如何设计国际 AI 监管机构的权限和结构?如何在不损创新的前提下实施 AI 安全审查?如何验证 AGI 的价值观一致性?这些问题在马拉比笔下以故事形式呈现,现在通过理论升华,我们看清它们正成为各领域专家亟待解决的课题。马拉比的贡献在于提供了丰富素材和初步思考,而理论的深化则需要学者和决策者进一步努力。

前沿研究案例与创新实践剖析

将书中理论应用于当代热点领域,可以检验其解释力,并为创新实践提供指导。我们选择三大前沿话题——数字生物学革命、人与 AI 交互的新范式、社交媒体与算法伦理,结合具体案例深入剖析书中观点在现实中的表现和影响。

案例一:数字生物学革命 – DeepMind 的 AlphaFold 成功开启了所谓“数字生物学”时代,即利用 AI 来加速生命科学发现。这是书中“AI 造福人类”理念的最佳注脚,也成为 AI 跨领域应用的标志性案例。通过 AlphaFold 的实践,我们评估哈萨比斯理论在现实科研中的效能:

- 实际表现:创新实践的涟漪效应:传统上需要数月乃至数年的实验,通过 AI 预测几分钟完成。

- 理论检验:窄域 AI 已经可以胜任极其复杂的科学挑战。这支持了技术乐观论:在合适条件下,AI 作为认知工具能极大扩展人类能力,助力科学“像骑自行车装上发动机”般提速。哈萨比斯将 AlphaFold 成果比喻为“亿万年博士时间在一年完成”,现实应用也确实体现指数级效率提升。这显示书中乐观观点在生物领域得到印证。同时,AlphaFold 团队坚持开放共享成果,也体现了哈萨比斯“AI 用于公益”的伦理主张。DeepMind 没有将 AlphaFold 商业垄断,而是向全社会提供公共平台,这在实践中赢得极大好评,被视为科技向善的典范。这说明负责任创新理念可以付诸实施,并带来良性影响。

- 局限与改进:马拉比强调的人类监督不可缺:AI 再强也需要专家判断配合,否则可能走偏。这正如哈萨比斯所说,AI 必须“与人类协同”才能发挥最大益处。未来的前沿实践应在“AI+ 科学家”模式上下功夫,开发友好的交互工具和解释方法,让科研人员能理解和信任 AI 预测。这可以看作 AlphaFold 继续前进的方向,也是对书中“AI 与人共舞”观点的实践回应。另外,AlphaFold 成功也带来 政策启示:各国开始重视 AI 在科研中的作用。例如英国政府 2023 年宣布大力投资“AI for Science”项目,美国 NIH 也设立专项资助 AI 药物开发。哈萨比斯倡导的“英国应抓住 AI 医疗机遇”正在部分实现——UK 政府与 DeepMind 合作新项目预测癌症等。这些都是书中理念推动现实改进的例子。

案例二:人机交互新范式 – 近年生成式 AI 的突破,引领了 人类与 AI 交互方式的革命。ChatGPT 等对话系统、AI 助理的崛起,使得哈萨比斯在书中展望的“普适数码助手”开始成为现实。以 ChatGPT 和谷歌新发布的 Bard 及即将推出的 Gemini 为例,分析书中思想在这一实践领域的体现:

- 实际表现:2022 年底,OpenAI 发布 ChatGPT,引发全球数亿用户参与,人机对话进入大众生活。2023 年,各科技公司竞相推出自家对话 AI,微软将 GPT 集成至必应搜索,谷歌发布对话 AI Bard 并宣布 DeepMind 研发更强多模态模型 Gemini。这预示“无处不在的 AI 助手”时代来临。从语言创作、代码编写到教育问答,AI 正在成为许多人日常助手。哈萨比斯所说的“Project Astra”设想(即个人随身 AI 助理,可能在手机或 AR 眼镜中)正在被推进。比如 OpenAI 计划整合 GPT 到智能眼镜中,创业公司 Humane 发布 AI 胸针概念产品,都验证了这一趋势。

- 理论检验:AI 普惠潜力 的观点。ChatGPT 的风靡证明,一旦 AI 门槛降低到对话界面,几乎人人都能受益于 AI 知识。这实现了某种民主化:专业能力(写文章、编程、翻译)通过 AI 向非专业人士开放。这印证了哈萨比斯“AI 将像骑士救兵般帮助解决问题”的乐观论调——例如,中小企业用 AI 客服提高效率,个人用 AI 翻译消除语言障碍等。同时,这也凸显社会适应曲线:就像书中所言“短期被高估,长期被低估”。最初有人认为 ChatGPT 无所不能(短期过度炒作),但长期来看,它对教育、工作方式的深远影响才刚开始(可能被低估)。哈萨比斯一贯强调 AI 中长期影响往往未受足够重视,这一判断可以延伸到生成式 AI:我们需要提前研究它对就业、学习的长线冲击。马拉比的叙述让我们意识到社会要有前瞻性。很快,教育界出现了对 AI 写作作弊的担忧,编程界担心 AI 取代初级工程师岗位。这些应对措施(如新教育考核方式、程序员转型提升技能)正在讨论中,体现书中观点的现实意义:AI 变革必须辅以人类制度变革。如不提前规划,社会可能措手不及。

- 风险与伦理:内容过滤、人工反馈强化(RLHF)等。OpenAI 甚至在 ChatGPT 之后成立“红队”专门发现有害用例。这些实践可以看做落实哈萨比斯“要确保 AI 有正确价值观”要求的尝试。例如,OpenAI 给 ChatGPT 内置一份“道德准则”让它遵循,这对应书中希望 AI 有“正确的价值和目标”。然而,现实表明,要让 AI 真正理解复杂的人类价值仍非常困难。目前 AI 过滤靠关键词和人工规则,常有失误(要么误杀正常内容,要么漏放不良内容)。这说明书中理想实现起来挑战重重。马拉比可能也意识到 AI 伦理将是一场长期博弈:每当模型进步,坏用法也翻新,需要不断治理。Google DeepMind 近期推出 SynthID 工具给 AI 生成图像加水印,帮助辨别真伪。这类创新实践是书中伦理框架在现实中的延伸应用,属于技术治理的一环。效果如何仍待观察,但至少证明了 AI 公司采纳“内置安全”理念开始具体行动。可以预期,在未来人机交互普及中,可信 AI 将成为关键研究方向,从算法层面(如可解释性)到产品层面(如用户监督界面)都需改进。这与哈萨比斯等推动“安全与机遇并重”不谋而合。

案例三:社交媒体与算法伦理 – 社交平台算法在传播领域造成的问题,虽非书中主线,但马拉比及哈萨比斯对硅谷的批评包含了对这一现象的不满。将这一领域纳入分析,有助于拓展书中关于伦理失范的技术后果之讨论。

- 实际表现:信息茧房和偏见放大等问题。DeepMind 虽未涉社交业务,但其母公司谷歌旗下 YouTube 发生过类似争议:2019 年有研究称 YouTube 算法将用户引向阴谋论视频,引发舆论抨击。谷歌被迫调整算法减少推荐不当内容。这些事实说明,缺乏伦理约束的 AI 算法 会带来严重社会后果。

- 理论对应:哈萨比斯对硅谷领导者“狂妄无道德”的批评可部分指向此类问题。他在与马拉比谈话中或许提到过对 Facebook 等行为的不满(书中未详写,但从其立场推测)。这是书中伦理主题在真实世界中的另一面:不光是 AGI 远期风险,眼前已有 AI 算法在侵蚀社会健康。这印证了 AI 伦理“近忧”和“远虑”科技与社会(STS)研究 的议题,即技术设计中蕴含的价值偏向如何影响社会。社交算法往往暗含商业价值(抓取眼球)凌驾公共价值(准确、客观)的偏向。这与哈萨比斯理想相悖,他认为技术开发应以造福社会为最终目的。因此,他痛斥硅谷一些领袖只逐利不顾后果。这说明马拉比书中对比的两种模式,不仅适用于 AI 研发,也适用于科技产品运营:没有伦理的商业导向将导致社会恶果。

- 改进举措:治理长期性。在创新实践上,也有新产品尝试不同价值导向的社交平台,例如 Braver 浏览器推出不跟踪用户、不做个性推荐的新闻聚合,以避免信息茧房。这类探索体现了技术设计重塑伦理的思路,即通过改变算法目标函数来更好服务公共利益。这与书中倡导为 AI 设定正确目标如出一辙。未来,或许社交平台会借助 AI 主动识别不良信息、平衡不同观点露出,这需要更高级的 AI 干预自己的输出,可视为 AI 调控 AI 的一种形态。这也呼应了哈萨比斯等对 AI 治理的想象:利用技术解决技术带来的问题,同时辅之以人类原则。社交算法案例也为 AGI 治理提供前车之鉴——如果连今天的相对简单算法都难以管控,AGI 时代更复杂。但也反过来激励研究者开发新工具(如 AI 检测谣言、深度伪造),加强内容审核自动化水平。DeepMind 在 SynthID 水印之外,也在研究用 AI 发现 AI 生成假新闻的方法。这些实践落实了“以攻对攻”的治理思路。

通过以上三个前沿案例的剖析,我们看到《哈萨比斯:谷歌 AI 之脑》中的理论在现实中得到了多方面的印证,也面临诸多挑战。在数字生物学方面,AI 大放异彩,证明了良好愿景的可行性,但也提醒我们要加强人机协作和正确引导;在人机交互方面,生成式 AI 普及验证了 AI 普惠价值,但副作用的治理需要持续努力;在社交算法方面,不负责任的 AI 应用已经造成危害,矫正工作迫在眉睫。这些案例既是对书中观点的现实检验,也是对其扩展和丰富。它们表明,要让哈萨比斯等人描绘的积极图景成真,社会必须正视并解决实践中暴露的问题。幸运的是,这些领域都出现了创新改进的苗头,体现出理论指导实践、实践反馈理论的良性循环。例如,AlphaFold 的成功推动了更多跨学科合作,ChatGPT 的挑战促进了 AI 伦理技术研发,社交媒体的教训加快了监管政策出台。这印证了马拉比在书末的希望:哈萨比斯的故事将改变公众对 AI 的态度。唯有公众充分认识 AI 的潜能与风险,社会各界共同参与,我们才能在实践中不断调整方向,让 AI 真正朝着有利于大多数人的方向发展。

理论的系统性与批判性再思考

在深入分析和跨学科扩展之后,有必要将书中的核心思想置于更广阔的当代背景下进行系统性、批判性的反思。人工智能的发展并非孤立,它嵌入了当代社会、技术和伦理的复杂生态。通过重新审视哈萨比斯理念的适用边界、现实风险和时代局限,我们可以发现需要完善和修正之处,并探讨使理论更加健全的策略。

适用性边界:哈萨比斯及 DeepMind 的经验,主要来自于超级精英团队和顶尖资源环境。我们要问的是:书中理想模式存在资源和规模边界。将理论推广时,必须考虑不同主体的处境。对于创业公司,也许需要调整期待,承认其商业化压力,寻求在商业成功与社会责任间的平衡点。国家层面同理:只有少数发达国家有能力投入大手笔 AI 基础研究,许多发展中国家难以跟上 AGI 竞赛脚步。这会否导致全球不平等加剧?哈萨比斯的故事主要聚焦英美科技圈,对其它地区着墨不多。但批判性反思要求我们注意这一盲点。当 AGI 成为现实,如何确保其利益为全人类共享,而非集中在少数强国?书中没有直接答案,需要补充以全球正义视角。可能的策略包括:加强国际科研合作,发起类似“人类基因组计划”的 AI 全球协作项目,让更多国家参与分享成果。这与哈萨比斯建议的“AGI 版 CERN”一致。我们意识到,这一建议的实现在政治现实下很难,但若不如此,AGI 可能加剧国际不均。这是理论适用性的地缘局限,需要认真对待。

现实风险与时代局限:眼前现实风险提及较少。前面案例分析中已指出,如 AI 导致失业、AI 偏见歧视等问题,在书中没有充分展开。这可能反映了时代背景的限制:马拉比成书时(2022-2025),ChatGPT 热潮刚起,人们更多关注宏大走向;一些具体社会影响还未充分显现或引起注意。然而,批判性再思考要求我们补全这些缺项。例如,AI 替代部分工作已是进行式,各国政府和社会需要应对失业和岗位转型挑战。哈萨比斯虽认为 AI 能带来“超级富足”,但未深入讨论如何分配这份富足。现实教训是,不加干预,科技收益往往集中于资本,因此再分配机制必须跟上(如实验性的 AI 红利税,用于给因 AI 失业者提供保障)。此外,哈萨比斯立场总体偏正面,他相信正确引导下 AI 好处大于坏处。然而,也许存在一种过度自信的偏误。批评者可能说:开发者往往低估不良用途的创造力。正如互联网初期少有人预料社交媒体会干预民主选举,AGI 也许有我们尚未想到的新风险。时代局限在于,我们都是以现有框架揣测未知。解决之道是倡导谦卑原则:在制定理论和政策时,要预留冗余,假设可能出错。例如,为 AGI 设定全球监控机制,一旦指标异常就紧急暂停,哪怕事先看似多此一举。这是批判性反思的意义:弥补乐观理论可能忽视的灰犀牛甚至黑天鹅风险。

理论完善与改进策略:基于以上反思,可以提出若干完善理论和实践的思路:

- 建立多学科常态化审议机制:AI 伦理与社会影响委员会,汇集科技、伦理、法律、经济等各领域专家,对 AI 重大发展进行评估和指导。类似机构已在欧盟等地出现,但需要赋予其更大权威和资源。哈萨比斯当初要求谷歌设伦理委员会可惜被取消,这说明企业自发的委员会易受利益驱动。批判性思考下,更有效的是政府立法强制重要 AI 项目通过独立伦理审查(类似药物审批需要伦理委员会)。这将书中倡导的责任原则制度化。

- 引入“渐进式保险”思维:渐进阈值机制:设定若干风险阈值(比如模型参数规模、人机交互自由度等),一旦达到阈值就暂停,评估安全后再继续。这有点像软件开发的阶段门。OpenAI 等已在部分采纳,如先内测调整再全开放。可以进一步完善为行业标准。这样既不一刀切停止创新,又不放任无底线冒进。哈萨比斯等支持的“对极端模型应暂缓”倡议就是这一思路的雏形,今后需要更精确具体的执行方案,批判性思维有助于设计细节。

- 加强公众教育与参与:公民陪审团或科技议题全民公投等实现。例如,某国可就“是否禁止自主杀人武器 AI”进行公民代表审议,给出建议。这将公众道德融入技术治理,弥补专家视角可能的局限。哈萨比斯多次提及要与各方 stakeholder 互动,这实际上需要机制化落地。不然,AI 决策仍集中在精英圈子,难免有偏颇或失察。

- 拥抱多元价值观:批判性再思考发现,书中讨论主要基于西方自由民主价值(强调个人、普世安全等)。但在全球范围,不同文化对 AI 的看法可能不同。比如,有的社会更强调集体稳定,宁可更强监管;有的文化对 AI 拟人化有禁忌(宗教影响)。AGI 治理需尊重多元观点,避免一刀切以某一价值体系衡量。否则,会有文化摩擦甚至冲突。为此,可以在国际 AI 框架中设立跨文化对话平台,倾听非西方国家和不同群体的关切,把例如数据隐私、算法公平等议题综合考虑。理论完善上,可引入后殖民技术观来审视 AI:防止技术霸权和价值霸权,让 AI 发展路径多样化且包容。哈萨比斯的理念虽好,但若被视为英美精英视角输出,推行时会遇阻。反思自己理论的文化局限,是必要的改进。

总结而言,通过系统性与批判性的再思考,我们并非否定马拉比和哈萨比斯的核心思想,而是对其补充完整,使之更加成熟稳健。理论的生命力在于自我批判和纠错。正如科技进步需要 trial and error,思想前进同样如此。《哈萨比斯:谷歌 AI 之脑》为我们提供了一个愿景与框架的起点,经由多学科的透视和反省,这一框架可以演化得更全面——既拥抱 AI 赋予人类的宏伟可能,也清醒认识到人性的复杂和制度的缺陷,然后在两者之间找到理性的平衡点。这样的理论才能经受时间和实践的检验,引领我们在未知的 AI 未来中走得更稳健、更安全。

实践反思与深度启示

在经历上述跨学科融合和批判反思后,我们有必要回到实际操作层面,凝练出对 AI 理论应用的常见误区、现实局限以及改进建议,并指明未来研究和实践应着力的方向。通过系统总结经验教训并提出可行策略,我们期望帮助读者以更前瞻和务实的态度理解和运用本书内涵。

常见误区与现实局限:

- 误区 1:技术万能主义 – 一些读者可能从哈萨比斯的传奇中得出“只要技术够强,一切问题都能解决”的印象。这是需要警惕的误区。实践表明,许多 AI 项目失败或遇阻,不是因为技术不够好,而是忽视了社会、制度和人文因素。例如某些医疗 AI 准确率很高,却因为医生不信任、法律未完善而无法应用。DeepMind 自己的教训亦在此:2016 年因未顾及患者隐私导致项目受挫。误区纠正:正如马拉比所强调,技术必须辅以正确应用场景和伦理配套。不要盲信 AI 能自动融入现有体系。实际部署需要考虑培训用户、法律合规、利益相关者接受度等。简单说,AI 方案至少 50% 是非技术因素。承认这一点,才能避免技术至上、忽略人的错误。

- 误区 2:静态视角看待 AI – 有些人把哈萨比斯书中观点当成固定真理,而忽略 AI 领域瞬息万变的特点。这导致要么迷信过时方法,要么低估新挑战。以 2021 年前风靡的自动驾驶为例,当时普遍预测 2025 年前无人车满街跑,但现实远比预期慢,因长尾场景、安全责任等瓶颈。启示:AI 理论和预测必须不断根据最新数据调整。哈萨比斯在不断更新其路线(如从游戏转向科学,又投身大模型),我们读者也应不断学习新知识。误区在于固守成见。正确做法是持续跟进 AI 前沿动态,将理论作为指南针而非僵化教条。

- 误区 3:忽视人性的弱点 – 技术理想主义者容易假设所有人都会理性使用 AI,但现实中,人性弱点(贪婪、恶意、无知)始终存在。例如,网络诈骗者很快学会用 AI 制作高仿声音行骗;社交平台为逐利明知算法有害也迟迟不改。这些都提醒我们:风险常在人的行为而非技术本身。哈萨比斯强调坏演员风险正切中要害。然而实践中常有人一厢情愿地开放强大 AI 工具却不加防范(比如开源高度可定制的深度伪造软件)。建议:AI 开发和部署时,要从最坏的人性出发考虑滥用场景,建立预防措施。这跟安全工程原则一致:假定破坏者无孔不入,然后构筑多层防线。忽视人性阴暗面的误区会让理论在现实中碰壁。我们务必以清醒悲观预期做最充分准备,以争取乐观结果。

- 现实局限:监管与协作困难 – 前述论及的许多改进策略,在现实推行时会遇到执行难题。例如国际合作治理 AGI,受制于大国博弈和信任赤字,短期看困难重重。国内层面,立法往往滞后科技发展多年,监管人员也缺乏 AI 专业知识。行业自律又往往难敌逐利冲动。马拉比书中寄望的理性协调在现实中步履维艰。这是 AI 理论应用的客观局限。应对:多方协同克服各自局限。监管可借助专家智库弥补知识差距,立法程序需加快探索“沙盒监管”(先试点再立法)。行业自律可引入第三方监督和公开透明度以提高可信。国际上,可从双边/小多边先行,比如美欧先达成 AI 准则,再逐步扩大范围。也要动员民间外交和跨国学术团体推动共识。尽管难,但不尝试就永无突破。理论在承认现实局限的同时,应激发行动意愿,以渐进步骤消除障碍。

改进建议与未来方向:

- 建立 AI 伦理与安全的“最佳实践”指南:AI 伦理最佳实践 指南,包括隐私保护、偏见检测、模型可解释、审计机制等具体措施。此指南应定期更新,供各企业和政府参考执行。它将实践中散落的智慧系统化,避免重复犯错,加速全行业提升安全伦理水准。这正是把哈萨比斯等倡导的责任理念转化为操作手册。

- 加强跨领域交叉研究:未来 AI 很多关键问题都在学科交叉地带。例如 AI 法学(如何定义 AI 法律人格、归责)、AI 心理学(人对机器信任关系研究)、AI 安全工程(攻击防御博弈)。鼓励并资助这些交叉领域研究,有望产出创新解决方案。DeepMind 内部已开展“AI+ 神经科学”交叉探索,卓有成效。类似地,AI+ 社会科学 的研究应得到更多支持,如利用社会学方法评估 AI 政策效果,心理学实验优化人机界面设计。马拉比书中跨学科思考给我们启示:突破复杂问题需要集思广益、融会贯通。因此未来教育和科研应打破专业壁垒,培养复合型人才应对 AI 带来的综合挑战。

- 公众赋能和韧性建设:终身学习账户,补贴劳动者随技术变化不断提升技能;鼓励产业转型和创业,缓冲可能的失业高峰。这体现哈萨比斯“AI 为社会全面福祉服务”愿景在现实的深化:只有民众整体获得新能力和保障,AI 红利才不会被少数人独占或引发社会问题。这方面有些国家已行动,如新加坡设立大规模再培训计划,美国部分州推行技术教育升级,都值得借鉴推广。

- 未来研究重点展望:在学术研究上,书中观点启发了一系列值得深入的问题:AGI 可控性(可证明安全的 AI 体系结构?)、价值对齐(如何形式化道德原则供 AI 内化?)、AI 应急停止按钮 理论(万一 AGI 失控如何一键关机)。这些议题已经在前沿讨论出现,未来 5-10 年将更加迫切。锁定这些方向,就抓住了哈萨比斯理论与当下热点的接口,将理念推进实际突破。

综上,实践反思与深度启示部分将繁杂的分析归结为可执行的要点。我们认识到,应用好本书的思想,需要避免理想化和片面化,多从现实出发进行调整;而真正让 AI 造福人类,需要行动者的持续努力和制度创新。这一部分的建议旨在为政策制定者、研究者和公众提供一个行动导向:既包括宏观层面的框架建立,也涉及微观具体的技能提升和项目实施。只有理论与实践相互促进,我们才能以“更具前瞻性和洞察力的角度”,迎接人工智能时代的机遇与挑战。这正是马拉比撰写《哈萨比斯:谷歌 AI 之脑》一书希望带给我们的深刻启示。通过汲取其中精华并结合现实改进,我们才能更全面地理解这场技术革命的内涵与意义,并在风云变幻的未来做出理性而智慧的集体抉择。

理论与现实的结合(Connection between Theory and Practice)

在前文的分析中,我们多次从理论高度探讨了书中观点与现实案例的互动。现在,让我们更加聚焦于理论在现实场景中的具体应用及表现,进一步将抽象理念落地,以便全面评估本书观点的实践价值。

理论应用一:AI 战略决策 – 哈萨比斯的核心理念已经影响到了一些现实中的 AI 战略决策。一个典型案例是谷歌在 2023 年的组织架构调整:将 DeepMind 与 Google Brain 团队合并,成立统一的 Google DeepMind 部门。此举正是出于对 OpenAI 竞争和 AGI 前景的判断,体现了理论对实践的指导。在马拉比书中,DeepMind 长期独立运作、偏重科研。但理论分析显示,当环境变化(ChatGPT 横空出世)时,需要将理论原则与现实需求相结合。谷歌 CEO 劈柴·皮查伊显然吸收了哈萨比斯及团队的意见:一方面保持科学探索的基因(让哈萨比斯任 Google DeepMind 主管),另一方面赋予其更明确的产品使命(开发对标 OpenAI 的大模型 Gemini)。结果如何?目前看,合并增强了谷歌内部凝聚力,加速了 Gemini 研发进度。这说明哈萨比斯提倡的“科学+产品”平衡在实践中找到了一个折中方案。马拉比理论预判的竞合趋势实实在在地体现在谷歌的组织实践上。这是理论-实践结合的正面范例:高层决策基于对核心理念的深刻理解做出调整,提升了企业应变能力。

理论应用二:AI 治理政策 – 从政策制定角度,本书思想也有现实回响。例如,2023 年各国纷纷推出 AI 治理框架,其中很多要点与哈萨比斯等专家的建议高度吻合。欧盟的《AI 法案》(拟立法)将高级 AI 系统列为高风险并要求强监管;美国白宫发布“AI 权利蓝图”,强调用户知情同意、公平、防止算法歧视。这些政策实践体现出责任伦理与法律规范并举的思路,与书中哈萨比斯呼吁“全世界需关注 AI 风险”的立场一致。更直接的例子是,英国于 2023 年末主办了全球 AI 安全峰会,召集各国政府和科技领袖探讨 AGI 风险防范,正式将“防范 AI 导致人类灭绝”写入会议宣言。这一前所未有的举措,正是响应了包括哈萨比斯在内科学家群体的呼声。峰会上,英国首相苏纳克引用了 AI 专家的警示,承诺建立全球安全监测中心等。这种高层表态背后,是理论逐步渗透决策的成果。批判看,政策落地仍需时间,但方向已明确。可见,马拉比书中的理论已开始塑造现实政策讨论的议程。实践与理论相互印证,增强了各国推进治理的决心。

理论应用三:企业伦理与社会责任 – 许多科技企业也受到本书思想影响,在内部制定了 AI 伦理守则。例如,微软、谷歌都发布了 AI 原则(公平、可靠、安全、包容、透明等),并建立 AI 伦理委员会审查产品。这与 DeepMind 创立之初就设伦理委员会(虽然后来波折)的做法类似,是哈萨比斯理念在更大范围的扩散。具体案例:微软在 2020 年否决了向加州警方出售面部识别 AI 的项目,理由是伦理风险未解决。这种企业自我约束,正体现了哈萨比斯强调的“有些技术宁可慢一点,也要确保安全”的原则。又如 Facebook 在 AI 研发中引入“红队”攻防测试模型,以发现滥用风险,也可看做应用了责任伦理理论。值得注意的是,这些实践并非直接由书中理念触发,但都能在马拉比理论框架下得到解释和支持。这反过来证明 理论的现实生命力:有效的理论能指导不同主体在不同情境下做出类似正确的选择。企业主动调整以规避伦理陷阱,正是理论与现实良性结合的体现。当然,不是所有企业都这么做,比如一些小公司仍然贸然推出未经充分测试的 AI 应用,导致丑闻(如 2022 年某招聘 AI 歧视女性引争议)。这表明理论应用的不平衡。然而总体趋势是在改善。哈萨比斯等的思想传播越广,越多企业会意识到社会责任也是商业长期利益的一部分,从而将理论内化为实践准则。

成功与失败案例:现实中既有运用书中观点取得成功的案例,也有偏离理论导致失败的教训:

- 成功案例:AlphaFold 的开源开放被誉为成功典范。DeepMind 本可以将其作为专利算法出售盈利,但遵循了“造福全人类”的初衷。这一决定得到学界和公众高度赞扬,为谷歌和 DeepMind 赢得口碑和信任,也刺激了更多人才加入、更多合作机会。长远看,这种负责任实践将带来更大价值(例如 AlphaFold 促成的药物成果最终也将收益于谷歌生态)。这里,理论(科技向善、分享共赢)指导了实践决策,实践又反证理论确实可行且有益。反观另一些公司选择封闭模式,则遭遇质疑或阻力。如有 AI 药物公司独占关键数据库,引发同行抵制。这对比凸显理论应用的重要性:深 Mind 用开放赢得“科学界的诺贝尔奖”(2024 年诺奖),而固守私利者可能错失共赢良机。

- 失败案例:前述 DeepMind- 皇家自由医院的数据违规事件即为典型失败。管理层当时显然没有充分应用“先寻求公众信任、合法合规”的伦理理论,而是片面强调技术可行性和善意目的,忽视了隐私法规。这导致项目被叫停,DeepMind 声誉受损。从理论角度看,这是没有遵守哈萨比斯自己提倡的价值:如果当初更透明、与患者沟通、获得明确同意,这项技术原本可以拯救生命且不引争议。此教训深刻,使 DeepMind 此后更加重视与公众和监管对话。这也印证理论在实践中的校正作用:失败推动理念更严格执行。再如,Uber 自动驾驶汽车在 2018 年撞死行人,调查发现其安全系统因赶进度被关闭,连最基本的“刹车”功能都人为禁用。明显违背了渐进安全测试理论。这一失败案例使整个行业陷入停顿,一年多无测试进展。后来各家吸取教训,重新强化安全冗余。这都说明偏离理论指导往往付出惨痛代价,最终又逼着大家回归理性原则。

成功原因与失败原因剖析:结合上述案例,可以总结出:

- 运用理论成功的原因在于决策者具有长远眼光和社会责任意识,愿意短期牺牲或额外投入以换取长期共赢。比如 DeepMind 开放 AlphaFold,其领导层看重的是人类科学进步这个更大目标,以及由此带来的声誉和人才吸引等隐性收益。这样的战略不是每个企业都敢做,但 DeepMind 验证了其可行性,从而使这种做法更容易被后来者接受。

- 理论未能指导实践导致失败,通常是短视逐利或过度乐观所致。如医院数据事件中,项目团队或许觉得测试性使用数据问题不大,未充分咨询法律专家;Uber 事故则显然是商业竞争压力下草率上路。这些失败背后都有对风险和伦理的忽视。哈萨比斯理论反复强调平衡和慎重,这些团队偏离了这些原则,故而失败几率大增。可以说,失败多半源自理论执行不到位或被利益驱动淹没。

通过这些现实印证,我们可以更加坚信马拉比书中阐述的理念的实用价值,也看到仅有理念还不够,关键在于实践主体如何执行。正如经济学所言,理性决策并不总是自发发生,需要制度和文化来支撑。因此,将理论有效融入实践,还需建立激励和约束机制。这呼应前文的建议部分:只有政策、行业准则和公众监督共同作用,才能确保更多行动遵循这些经验证正确的原则。

实践价值评价:宏观战略(国家 AI 政策、企业研发方向),还是在微观执行(项目管理、风险控制),我们都能找到对应的成功案例。失败的教训也在不断印证这些理论的重要性。可以说,这本书提供了一个实践指南针:提醒科技界在 AI 竞赛中不要迷失方向,提醒社会各方在拥抱 AI 时不要丢掉伦理罗盘。理论与实践结合得越紧密,我们越能少走弯路、少犯错误。从这个意义上讲,马拉比的著作不仅是对过去的总结,更是对未来行动的引领。连接理论与现实,正是为了将纸上洞见化为现实生产力,推动人工智能以正确的方式造福人类。这也是本书给予我们的最重要启示之一。

作者的写作技巧和风格分析(Analysis of Author’s Style and Methodology)

塞巴斯蒂安·马拉比作为本书作者,运用了高超的写作技巧和独特的叙事风格,使得这样一部涵盖技术、人物和思想的著作既引人入胜又发人深省。在本节中,我们将深入探讨作者的论证逻辑、叙述策略、语言特色,以及他如何通过结构设计和案例选择来增强说服力、影响读者认知。

论证逻辑清晰缜密:马拉比具有经济学和新闻评论背景,擅长构建有条理的论证框架。在本书中,他采用“总分总”先提出观点,再举例支撑,最后分析。比如在论述“硅谷与哈萨比斯理念的对比”时,他先概括指出哈萨比斯“furiously critical”硅谷,接着列举他批评的具体言论和事例,最后分析其背后反映的创新模式冲突。这种三段式论证使每个观点都有理有据,读者很容易被说服。

叙述策略交织人物与思想:叙事与议论并重,人物故事与概念分析交织推进。他并未写成干巴巴的理论专著,而是以哈萨比斯的人生经历为主线娓娓道来,将深刻思想巧妙融入情节。一方面,他具备传记作家的笔力,把哈萨比斯刻画得生动立体。书中大量细节刻画如少年哈萨比斯沉迷国际象棋的场景、2016 年围棋赛后他与团队喜极而泣的瞬间等,使读者仿佛身临其境。这种故事化叙事提高了可读性和感染力。另一方面,马拉比善于在关键节点插入议论性旁白,引导读者思考人物行为背后的意义。例如,描述 AlphaGo 取胜后,他并不停留在表面胜利,而是笔锋一转:“这不仅仅是人机胜负,更预示了技术如何改变未来”。通过这样的议论,作者将故事提升到思想层面,实现对主题的深入探讨。因此,本书在传记和思想书两个层面都出色:既有引人入胜的剧情,又有发人深省的观点。

语言特色生动且恰如其分:新闻记者的简洁精准和文学作者的生动比喻。他常用简练而有力的短句总结观点,让人印象深刻。例如他写道:“The inventors believe they control their technology, but often, the technology controls them.”短短一句警句般的话,铿锵有力地点出“反噬”这一主题,让读者过目难忘。同时,他也擅长运用比喻和意象,使抽象概念形象化。书中多处引用其他名人的评价和比喻,如将哈萨比斯比作“硅谷众天才中的特殊个案”、将 AI 革命比作“我们时代 70,000 年来最重要的转折”等。这些比喻提升了语言的张力和感染力。此外,他会引用当事人的原话,以第一人称引语增加临场感。例如引述李世石赛后说“我无言以对……”,这真实还原了情绪,使读者与人物共鸣。作者还善用反问和排比等修辞增强说服。如在阐述 AI 风险时,文中以反问“如果突然出现一个比任何人都聪明的群体,我们会问它们意图如何?”将问题抛给读者,加深思考。这些语言技巧使行文富于变化,不枯燥说教而是引人思考。

结构设计服务说服力:交替叙事方式:科技事件和个人经历穿插。例如讲到 DeepMind 开发 AlphaFold 解决科学难题后,紧接着回顾哈萨比斯当年攻读神经科学博士的往事,让读者明白正是个人积累促成今日突破。这种素材安排突出“个人与事业交融”的主题。其次,他聚焦关键节点:深 Mind 十余年历程中,他重点写了 2014 年谷歌收购、2016 年 AlphaGo 胜利、2020 年 AlphaFold 成功等几个“高潮”事件。通过描绘这些高潮情节,作者抓住了读者注意力,并在高潮处展开深入分析,使读者在情感最投入时接受他的观点。例如 AlphaGo 比赛章节,他渲染了赛场气氛和双方精彩着法,当读者兴奋不已时,他顺势讨论 AI 与人类智慧的关系。这种张弛有度的结构设计大大提高了说服力,因为读者此时情感和理智都被调动,自然更能认同作者论点。再如 AlphaFold 章节,先以科学 50 年难题告破震撼登场,随后高屋建瓴讨论 AI 对各领域的助益。这样的结构令观点有坚实事例依托,说服力极强。

案例选择多样且典型:标志性事件作案例,如 AlphaGo 之战、诺奖获奖、马斯克评价等。这些事件本身广为人知或戏剧性强,能引起读者兴趣和共鸣。另一方面,他也穿插了一些鲜为人知但有启示的小故事。例如哈萨比斯童年时在公园同时下多盘棋战胜成年棋手的轶事,或者 DeepMind 团队内部一次失败的研究尝试。这些小案例使人物形象更丰满,也体现出成功背后有挫折、荣耀之外有平凡。这种细节让读者感觉作者不是在神化哈萨比斯,而是如实呈现一个人、有血有肉的科学家。这样的案例运用策略增加了可信度:当作者赞扬哈萨比斯时,因之前已展示其人性面,读者更容易接受,不会觉得在盲目吹捧。同样,对于争议性话题,马拉比也提供多面案例。例如谈及 AI 风险,他既引述了哈萨比斯不眠思虑,也提到乐观派如某些专家不以为然的声音。通过案例来体现不同立场,作者显得公允客观,增强了信任。

提高说服力的细节技法:马拉比还通过一些细节写作技巧来润色论证,使之更具说服力和感染力:

- 前后照应与伏笔:书中许多前文提到的细节在后文再次出现,形成照应。例如开篇写哈萨比斯幼年象棋神童,结尾处引用他夺诺奖时仍提及当年棋艺启蒙。这种呼应让读者感觉叙事完整,有“命运铺陈”之感,人物形象更富传奇色彩,也加深印象。

- 第三人称客观视角:尽管作者对哈萨比斯抱有崇敬,但写作时仍保持第三人称描述,不直接流露个人赞美,而是通过事实和他人评价传递。例如通过引述沃尔特·艾萨克森等名人的赞誉,借名人之口来肯定哈萨比斯。这样读者更容易信服,因为感觉不是作者单方面吹捧。这种客观式塑造非常巧妙。

- 平实理性与激情煽动结合:作者大部分行文理性克制,用词准确。然而在应有之处也不吝使用一些感情色彩浓的词句来煽动读者情绪。如 AlphaGo 胜利后写“这是一刻令人心碎又壮丽的时刻”、“如此美妙”,用旁观者 Fan Hui 的重复感叹带出情绪。这寥寥几笔,就把读者的激动心情点燃,同时又不显得矫情,因为是引语形式。理性部分则用数据、年份、头衔等客观信息让人信赖,例如明确指出 DeepMind 获得诺奖等事实。这种情理相济的语言拿捏,使全书张弛有致。

综上,塞巴斯蒂安·马拉比在《哈萨比斯:谷歌 AI 之脑》中展现了大师级的写作技巧:结构谋篇,逻辑透彻;叙事生动,议论深刻;语言精练,又富有文采;案例精当,细节传神。他通过娴熟的笔法将复杂的科技故事讲述得引人入胜,同时蕴含丰厚思想,让读者既受启迪又感亲切。这种以小见大、寓理于事的写作方法无疑大大增强了本书的说服力和影响力。对读者而言,这种风格也提供了一种“润物细无声”的影响——我们在享受故事的同时,不知不觉已被植入对 AI 的思考和立场。这正是马拉比行文的高明之处:不显山露水,却春风化雨,完成了对读者认知的潜移默化塑造。

批判性观点与不同视角(Critical Perspectives and Alternative Views)

尽管《哈萨比斯:谷歌 AI 之脑》广受好评,也代表了主流舆论对人工智能革命的看法,但围绕本书和哈萨比斯本人,也存在一些批判性观点和不同看法。综合英文资料中的各种声音,有助于我们从更多角度全面理解这部作品和其中的论点。下面,我们整理并阐释几种主要的异见,分析其理由以及对整体理解的启示。

不同视角一:英雄叙事的质疑 – 有评论者质疑,马拉比的写作是否过于突出个人英雄作用,而忽视了团队和更广泛的社会因素。哈萨比斯固然卓越,但 DeepMind 成功离不开数百名顶尖研究员的协作,也离不开谷歌的财力支持和学术界的知识累积。一些评论认为本书采用了硅谷常见的“英雄传”模式,将复杂的集体创新简化为个人天才的故事。例如,《金融时报》评论员约翰·索恩希尔(John Thornhill)就指出:“DeepMind 的成就并非一人之力,马拉比虽提及团队,但整体叙事仍高度集中于哈萨比斯视角。”这种批评的理由在于,科技创新往往是群体智慧迸发的结果,过度强调个人可能导致对创新过程成因的误解。这个异见启示读者,要警惕“伟人史观”在科技报道中的影响。确实,马拉比书中虽然采访了 Mustafa Suleyman 等人并提及他们贡献,但主线仍以哈萨比斯为核心。这无可厚非,毕竟是人物传记,但批评者提醒我们应看到 DeepMind 背后的集体网络:有前辈 AI 科学家(如辛顿、勒昆)奠基、也有竞争对手(如 OpenAI 团队)的刺激、更有政府和资本提供环境。本书没有详细展开这些背景,这并非疏漏,而是侧重点不同。然而,这种不同视角帮助我们拓宽认知:哈萨比斯虽是引领者,但 AI 革命是更大群像。

不同视角二:风险评估的分歧 – 对于 AI 风险,不同专家意见分野较大。本书和哈萨比斯属于中间偏审慎阵营,既不否认 AGI 潜力,也强调安全。然而,有两极观点值得一提:一是极乐观派的不同看法,二是极悲观派的更激进主张。

- 极乐观派(如 Meta 首席 AI 科学家 Yann LeCun 或软件自由主义者)认为,马拉比书中对 AI 失控的担忧被夸大。LeCun 多次公开表示不同意“AGI 灭绝论”,认为 AI 不会产生自我意志,要害在于人类使用方式。此派批评哈萨比斯等“大惊小怪”,可能在他们看来,DeepMind 强调安全的立场有保护既得利益、放慢他人脚步之嫌。他们的理由是,历史上一些新技术的悲观预言并未成真(如有人曾担心电力普及导致灾难,结果人类适应了)。他们觉得 AI 也将如此,人类完全可以控制并受益,不必渲染末日景象。这种异见启示我们:AI 风险评估确实存在不确定性,过度聚焦最坏情景可能忽略 AI 眼前益处。但是,对比论据也表明,乐观派有时低估了新技术与以往不同之处(AI 的自主性前所未有)。因此,两种视角需要平衡。马拉比书中基本站在主流中立点,但吸纳乐观派的批评有助于避免陷入“恐慌叙事”陷阱,激励我们理性看待机遇。

- 极悲观派(如“AI 停止 6 个月公开信”的发起者、未来生命研究所等)对哈萨比斯的立场也不尽满意。他们更倾向于采取激进行动,如暂停大模型训练甚至国际禁令,以防 AGI 灾难。他们的异议在于,像哈萨比斯这样深处巨头的从业者,或许无法真正放缓脚步,因为商业利益羁绊。因此这些批评者认为,仅靠业内自觉不够,必须有外力逼停。他们甚至可能认为马拉比书中对哈萨比斯塑造略带“救世主”色彩,却未过多提及他也是谷歌高管,身处利益冲突(既想安全又要推动谷歌竞争)的微妙位置。有评论指出:“DeepMind 被谷歌收编,哈萨比斯的自由度再不及以往,他是否还能坚持初衷?”这质疑了哈萨比斯话语的可靠性,提示我们理解他身份的双重性:既是理想主义者也是企业管理者。悲观派的声音敦促读者别对大公司高管抱过高期望,而应推动独立监管。这拓展了我们看问题的角度,让对书中人物的评价更为全面客观。

不同视角三:伦理侧重点的不同 – AI 伦理议题宽广,不同群体关注点不同。本书强调的是“灾难性风险”与“大局伦理”(如存在性风险、全球治理)。但来自 AI 伦理学界另一些声音 认为,此类宏大伦理讨论有遮蔽现实不公之嫌。例如,AI 偏见、监控滥用等当下伦理问题需要更多讨论,而“AGI 末日”反而可能转移注意。麻省理工教授 Kate Crawford 等批评一些科技领袖热衷谈末日场景,却对当下诸如 AI 种族偏见、劳动剥削问题态度消极。他们认为应将伦理重心从“未来假设”转向“现存伤害”。这和前面我们自己分析的差不多,但作为不同视角出现很重要。其理由是:AI 已经在伤害弱势群体(如面试 AI 歧视残障人士、算法判刑歧视黑人),这些马拉比书中涉猎较少。对整体理解的启发是:我们应将哈萨比斯理念与其他伦理视角结合,不能只关心天降奇祸,也要脚踏实地纠偏。马拉比并非有意忽略,只是聚焦不同。批评者的声音提醒读者,在欣赏 DeepMind 远虑时,也别忘记身边正发生的不公。两者均需解决。换言之,伦理议题有层次之分:既要防范末来可能的世界级风险,也要修补目前已有的局部问题。平衡这两者,是 AI 伦理讨论应有的格局。不同视角的碰撞,有利于我们避免“一边倒”视野,看清全面伦理图景。

不同视角四:竞争对手的观点 – 另外值得一提的是来自哈萨比斯竞争者阵营的不同声音。例如,OpenAI 的领导层或许对 DeepMind/谷歌抱有不同看法。一些访谈中,OpenAI CEO 山姆·阿尔特曼曾暗批谷歌“裹足不前”,导致 OpenAI 有机会突破。这意味着另一种叙事:创新不应过度求稳,勇敢尝试才能大步推进。这个视角和哈萨比斯强调安全稳健略有冲突。OpenAI 的观点可能是,如果大家都像 DeepMind 那么谨慎,GPT-4 也许不会这么快出现供公众用,他们认为尽早公众接触 AI 有利于反馈改进和社会适应。这种观点反映在一些媒体评论里,认为马拉比书多少代表了“老派守成者”的调调,而 OpenAI 代表“新锐颠覆者”。当然,这未必公允,但提醒我们:创新路径之争也是不同视角焦点。哈萨比斯路径强调基础研究和长线目标,另一路径强调产品迭代和短期实效。评论界围绕这一点也有争论,有人支持 DeepMind 模式科学严谨,也有人佩服 OpenAI 灵活实干。这丰富了读者对 AI 发展路线的理解,知道不止一种方式通向 AGI。马拉比书中显然对哈萨比斯模式持肯定态度,但开放性读者可参照另一视角,对比优劣。这正拓展了我们的认知边界。

不同视角的启发价值:总体来说,这些批判性观点与异见拓宽了我们理解本书的语境:

- 英雄叙事质疑让我们思考个人与集体的关系,不神化单一人物。

- 风险评估分歧让我们平衡乐观与悲观,避免走极端。

- 伦理侧重不同提醒我们兼顾眼前与长远,全面落实责任。

- 竞争模式之争启示我们包容多元创新策略,因为未来可能是多路径汇合。

通过这些不同视角的碰撞,读者的认识将更加立体和成熟。本书所倡导的 AI 革命愿景并非没有缺漏,通过吸纳批评者的洞见,我们可以对其进行修正和补充。比如看到英雄背后的团队、安防远虑的同时先治近忧、既谨慎又不失进取……这些都是异见带来的重要启示。不同声音拓展了我们对 AI 的集体认知,对全面理解书中内容也有帮助:我们不应将马拉比的叙事视作唯一标准答案,而应将其与其他观点对话,在比较中找出更健全的认识。这种多视角方法正是一种批判性思维的体现,也回应了作者本身希望引发思辨的初衷。真理越辩越明,通过这些批判性讨论,我们既发现了本书的亮点,也看清其局限,从而对人工智能的未来形成更全面冷静的判断。

总结与启示(Conclusion and Insights)

经过对《哈萨比斯:谷歌 AI 之脑》一书的全面解读和多角度分析,我们可以对全文的核心价值和理论贡献作出深度总结,并提炼出其对相关领域未来发展的重要启示。

全书核心价值与理论贡献:人工智能革命整体脉络和关键命题的系统思考。它的核心价值在于:

- 刻画时代英雄,映射技术灵魂:人性的温度和情感的共鸣。这一点极大地拓展了读者对 AI 的理解维度:我们意识到,技术进步离不开人的推动,AI 的发展也是人类精神的一种投射。马拉比因此为人工智能立传,也是为我们这个蓬勃而充满矛盾的时代立传。

- 整合跨学科洞见,奠定认识框架:理论框架。这一框架以“创新-伦理-权力”三要素为轴心:创新驱动力决定了 AI 可能性,伦理责任制约着 AI 边界,全球权力竞逐则加速并方向性影响 AI 进程。马拉比通过哈萨比斯的经历,巧妙地将这三者织入故事,给出了 AI 发展“为什么重要、如何把握、何处引领”的系统答案。这一框架是本书重要贡献,帮助读者建立对 AI 的宏观认识坐标。当我们展望未来,不再零散地看待 AI 某项技术或单一事件,而是能从整体视角出发,分析 AI 事件对创新演进、道德规范和世界格局的综合影响。这种整体性思维将是理解和参与 AI 时代的必备素养,而本书为此打下了基础。

- 提供理性中道的立场,凝聚共识:建设性讨论的氛围,为 AI 领域不同立场的人搭建起沟通桥梁。这一点在当前极化的科技伦理争论中尤为可贵。本书因此有潜力影响决策者、业界、学界和公众各方,推动他们形成基本共识:AI 是大势所趋,我们应共同努力,让它朝好的方向发展。这样的共识正是 AI 治理所需要的第一步,而马拉比在书中已经开始为此奠基。

对未来发展的启示:展望人工智能及相关领域的未来,本书的内容和分析为我们提供了若干启示:

- 坚持长期愿景,平衡短期利益:长线思维:不被眼前得失绑架,敢于投入基础研究,容许创新试错。唯有如此,才能真正抓住 AI 革命带来的战略机遇,而不致因短见而错失。与此同时,也应引以为戒,长远理想不能脱离现实资源和环境,需要以阶段性成果支撑,从而获得持续动力。这种长短期的平衡,在未来将是一门高超的领导艺术。从哈萨比斯身上,我们看到值得效法的榜样——既心怀星辰大海,又脚踏坚实土地。

- 强化全球合作,避免零和竞赛:书中反复强调 AI 是人类共同面对的机遇与挑战。任何一方试图独占 AI 优势,最终可能引发冲突或带来集体风险。这给我们的启示是,合作是有可能的:哈萨比斯能和竞争对手 Amodei 坐在一起畅谈责任,这说明人类完全可以超越立场,在更高层面携手。未来 AI 的正道在于联手驯服这头“智能巨兽”,而非各怀鬼胎地放纵它生长。

- 完善监管治理,弘扬责任伦理:规制来引导其走善道。马拉比书中强调的“奥本海默困境”提醒我们,对待 AI 应如履薄冰,有所不为。这一理念未来应转化为实实在在的法律法规、行业标准和伦理准则。我们可以预见,AI 治理将成新兴学科和政策领域。各国需要培养既懂技术又通伦理法律的人才,加快建立适应 AI 时代的监管框架。比如许可制度、测试认证标准、风险预警机制等等。哈萨比斯推动的内部安全审查未来或上升为强制要求。责任伦理也应嵌入 AI 开发流程,从算法设计、数据采集到部署反馈,每一步都应该有伦理“阀门”。此方面,本书提供了精神指引:利他与谨慎。深 Mind 的故事证明,秉持责任并不会妨碍创新,相反还能换来更持久的成功。未来的 AI 开发者和政策制定者,应将“不能因为能做就去做”(Don’t move fast and break things)奉为圭臬。只有时刻警醒风险、敬畏后果,我们才能避免重蹈核武之覆,确保 AI 之火为我们所用而不成燎原之灾。

- 拥抱跨学科融合,推动协同创新:跨界协同的思想火花。心理学家、社会学家、医学家与 AI 工程师合作,才能创造出真正以人为本、服务社会的 AI 产品。经济学家和政治学家与算法设计者对话,才能制定出既鼓励创新又防范垄断与失业的政策。本书启示我们,“术业有专攻”需要升级为“术业有合作”。马拉比跨界写作的成果正说明,知识的融合将带来更深的洞见。因此,面向未来,我们应打通学科壁垒,培养综合型人才,共建交流平台,让不同背景的人士在 AI 议题上形成持续对话机制。这将极大提高我们应对复杂问题的能力,使人类在 AI 时代更具韧性和创造力。

读者后续阅读建议与研究方向:为了进一步探索或应用本书内容,读者可以考虑以下方向:

- 延伸阅读:若对 AI 技术本身感兴趣,可阅读马丁·福特《AI 时代》、尼克·博斯特罗姆《超级智能》、凯文·凯利《必然》等,了解不同作者对 AI 未来的看法,和本书形成对比。的引用也提到了 Suleyman 与 Ian Bremmer 在《外交事务》上称 AI 为“世界改变者”的文章,可全文研读以获悉另一种表述风格。此外,沃尔特·艾萨克森的《埃隆·马斯克传》等传记,可比较不同科技领袖的共性与差异。

- 深入研究:学术上,有志者可从本书启发出具体课题。例如,“AGI 国际治理模式比较研究”、“AI 伦理风险案例库构建”、“AI 领导者决策心理学分析”等。这些方向顺应当前学界潮流,既有理论意义也具现实价值。DeepMind 与 OpenAI 策略比较、AI 项目成败因素分析等也可作为 MBA 或公共政策案例研究。

- 实际行动:普通读者也可将本书启示应用于自身领域。如果您是企业管理者,不妨思考如何在公司倡导负责任创新文化;如您是教育者,可将 AI 科普与伦理纳入课程,培养学生正确观念;如您是开发者,更应以哈萨比斯为榜样,坚持攻坚克难同时不忘安全底线。对公众而言,参与 AI 公共讨论、支持明智监管、警惕不实夸大,也是实践本书精神的一部分。

总之,《哈萨比斯:谷歌 AI 之脑》给我们带来的,不仅是对过去故事的了解,更是一份面向未来的精神财产。它告诉我们:在巨变时代,理想与责任同样重要;在人机交互中,人性的智慧不可或缺;在机遇风险前,合作比对抗明智。如果说哈萨比斯以其人生给 AI 革命树立了一个标杆,那么马拉比则以文字为我们刻画了这根标杆的高度和方向。面向未来,我们应继续仰望并追随这根标杆,同时用批判和进取的精神不断校准自己的航向。唯有如此,我们才能在人工智能的浪潮中立足前沿、拥抱创新,最终实现哈萨比斯式的愿景:让人工智能真正成为人类福祉的加速器,而非失控的潘多拉盒子。